Материалы по тегу: in-memory

|

24.01.2025 [14:33], Сергей Карасёв

Бывший гендиректор Intel Пэт Гелсингер инвестировал средства в ИИ-стартап FractileЭкс-гендиректор Intel Пэт Гелсингер, по сообщению TrendForce, стал инвестором британского стартапа Fractile.ai, который специализируется на разработках в области ИИ. Сумма, которую предоставил бывший глава Intel на развитие этой компании, не раскрывается. Fractile.ai основана в 2022 году Уолтером Гудвином (Walter Goodwin) — специалистом, получившим докторскую степень в области искусственного интеллекта и робототехники в Оксфордском университете. Стартап разрабатывает специализированные ИИ-чипы, использующие метод вычислений в оперативной памяти. Такой подход может существенно повысить скорость инференса и выполнения других задач, связанных с интенсивными вычислениями. Утверждается, что по сравнению с традиционными ИИ-ускорителями на базе GPU решения Fractile.ai обеспечат ряд значительных преимуществ. В частности, говорится, что новые чипы позволят поднять производительность больших языковых моделей (LLM) в 100 раз при одновременном 10-кратном снижении затрат по сравнению с решениями NVIDIA. При этом чипы Fractile.ai обеспечат в 20 раз более высокую производительность в расчёте на 1 Вт затрачиваемой энергии по сравнению с любым другим оборудованием ИИ, представленным в настоящее время на рынке. Однако пока Fractile.ai не изготовила тестовые образцы изделий, а оценка их характеристик и возможностей проводится путём компьютерного моделирования. Тем не менее, Гелсингер говорит, что ни один подход в отношении ИИ-вычислений не воодушевляет его больше, чем тот, который предлагает Fractile.ai. По его словам, для дальнейшего масштабирования ИИ большое значение имеет снижение как энергопотребления, так и стоимости вычислений. Отмечается также, что стартап Fractile.ai ранее привлек в общей сложности $17,5 млн финансирования. В число инвесторов входят Kindred Capital, NATO Innovation Fund, Oxford Science Enterprises и несколько бизнес-ангелов.

20.01.2025 [07:53], Владимир Мироненко

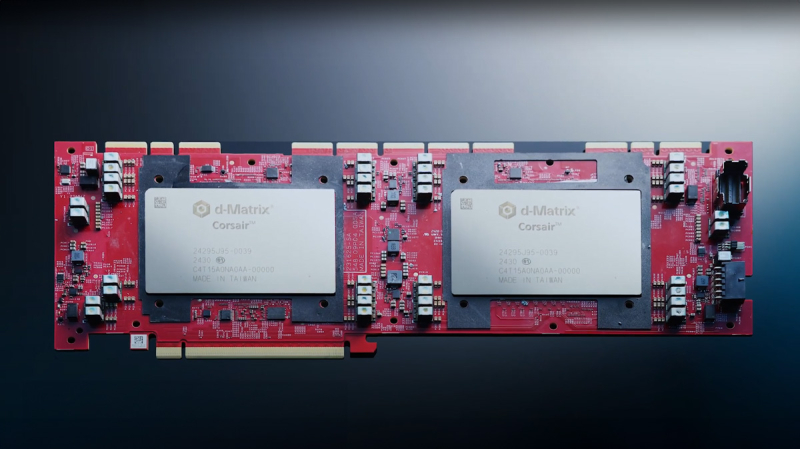

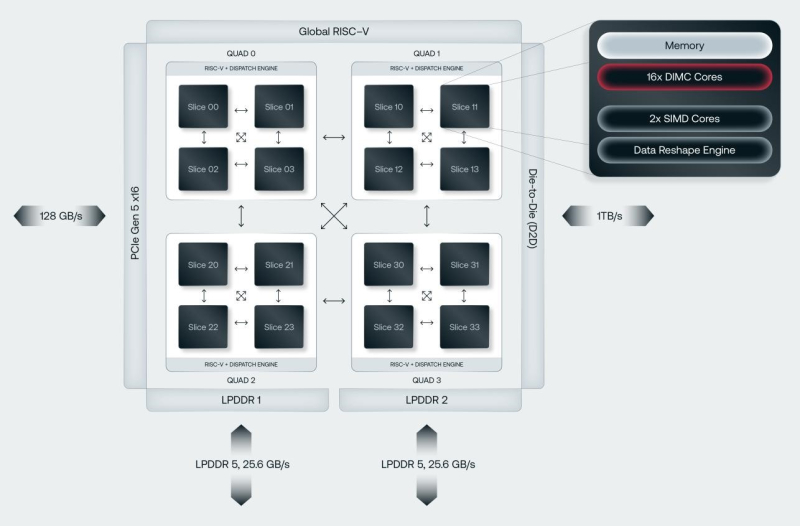

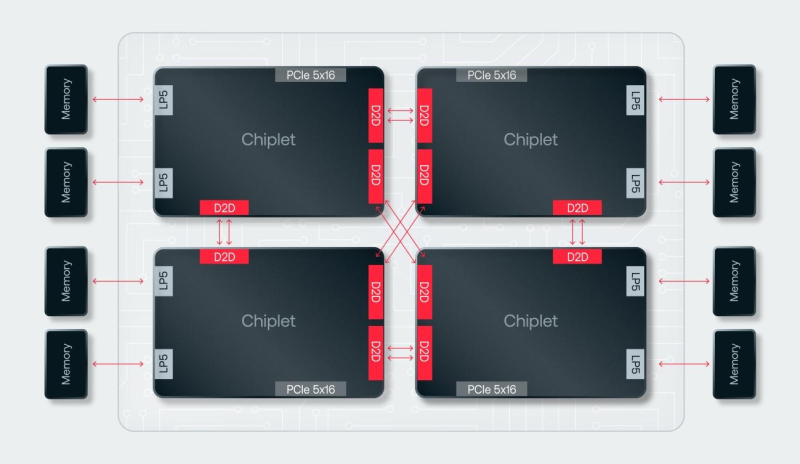

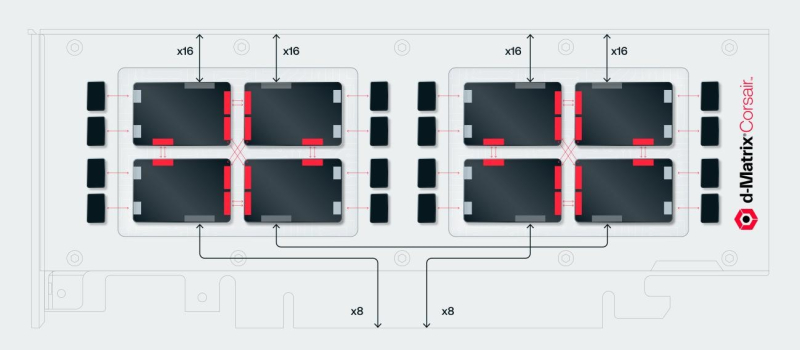

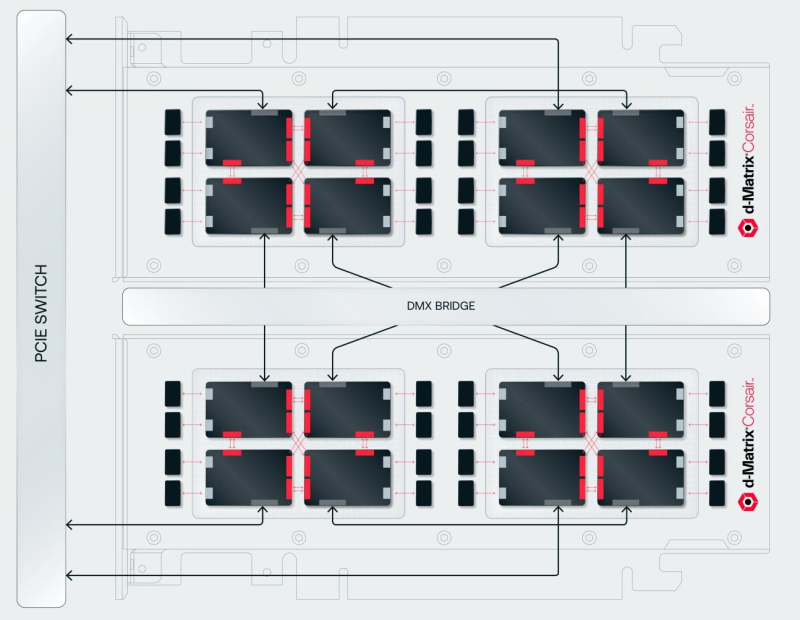

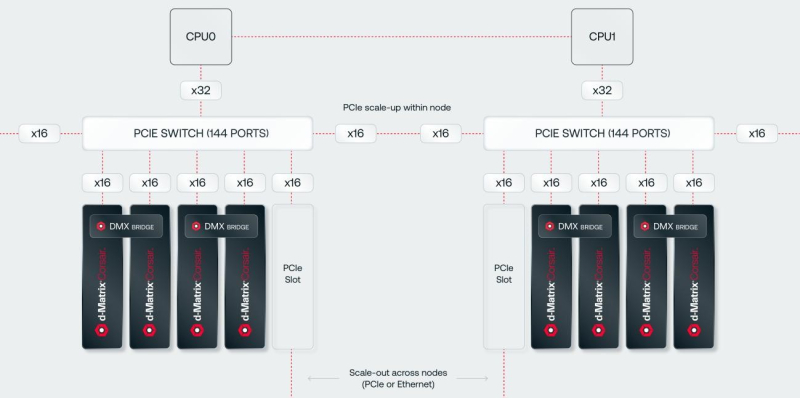

SRAM, да и только: d-Matrix готовит ИИ-ускоритель CorsairСтартап d-Matrix создал ИИ-ускоритель Corsair, оптимизированный для быстрого пакетного инференса больших языковых моделей (LLM). Архитектура ускорителя основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC), работающих на скорости порядка 150 Тбайт/с. Новинка, по словам компании, отличается производительностью и энергоэффективностью, пишет EE Times. Массовое производство Corsair начнётся во II квартале. Среди инвесторов d-Matrix — Microsoft, Nautilus Venture Partners, Entrada Ventures и SK hynix. d-Matrix фокусируется на пакетном инференсе с низкой задержкой. В случае Llama3-8B сервер d-Matrix (16 четырёхчиплетных ускорителей в составе восьми карт) может производить 60 тыс. токенов/с с задержкой 1 мс/токен. Для Llama3-70B стойка d-Matrix (128 чипов) может производить 30 тыс. токенов в секунду с задержкой 2 мс/токен. Клиенты d-Matrix могут рассчитывать на достижение этих показателей для размеров пакетов порядка 48–64 (в зависимости от длины контекста), сообщила EE Times руководитель отдела продуктов d-Matrix Шри Ганесан (Sree Ganesan). Производительность оптимизирована для исполнения моделей в расчёте до 100 млрд параметров на одну стойку. По словам Ганесан, это реалистичный сценарий использования LLM. В таких сценариях решение d-Matrix обеспечивает 10-кратное преимущество в интерактивности (время до получения токена) по сравнению с решениями на базе традиционных ускорителей, таких как NVIDIA H100. Corsair ориентирован на модели размером менее 70 млрд параметров, подходящих для генерации кода, интерактивной генерации видео или агентского ИИ, которые требуют высокой интерактивности в сочетании с пропускной способностью, энергоэффективностью и низкой стоимостью. Ранние версии архитектуры d-Matrix использовали MAC-блоки на базе SRAM-ячеек, дополненных большим количеством транзисторов для операций умножения. Сложение же выполнялось в аналоговом виде с использованием разрядных линий, измерения тока и аналого-цифрового преобразования. В 2020 году компания выпустила чиплетную платформу Nighthawk на основе этой архитектуры. «[Nighthawk] продемонстрировал, что мы можем значительно повысить точность по сравнению с традиционными аналоговыми решениями, но мы всё ещё отстаем на пару процентных пунктов от традиционных решений типа GPU», — сказал EE Times генеральный директор d-Matrix Сид Шет (Sid Sheth). Однако потенциальным клиентам не понравилось, что при таком подходе возможно снижение точности, так что в Corsair компания вынужденно сделала выбор в пользу полностью цифрового сумматора. ASIC d-Matrix включает четыре чиплета, каждый из которых содержит по четыре вычислительных блока, объединённых посредством DMX Link по схеме каждый-с-каждым, и по одному планировщику и RISC-V ядру. Внутри каждого вычислительного блока есть 16 DIMC-ядер, состоящих из наборов SRAM-ячеек (64×64), а также два SIMD-ядра и движок преобразования данных. Суммарно доступен 1 Гбайт SRAM с пропускной способностью 150 Тбайт/с. ASIC объединён со 128 Гбайт LPDDR5 (до 400 Гбайт/с) посредством органической подложки (без дорогостоящего кремниевого интерпозера). Хотя текущее поколение ASIC включает только четыре чиплета именно из-за ограничений подложки, в будущем их количество увеличится. Внешние интерфейсы ASIC представлены стандартным PCIe 5.0 x16 (128 Гбайт/с) и фирменным интерконнектом DMX Link (1 Тбайт/с) для объединения чиплетов. FHFL-карта Corsair включает два ASIC d-Matrix (т.е. всего восемь чиплетов) и имеет TDP на уровне 600 Вт. Ускоритель работает с форматами данных OCP MX (Microscaling Formats) и обеспечивает до 2400 Тфлопс в MXINT8-вычислениях или 9600 Тфолпс в случае MXINT4. Две карты Corsair можно объединить посредством 512-Гбайт/с мостика DMX Bridge. Их, по словам компании, достаточно для задействования тензорного параллелизма. Дальнейшее масштабирование возможно посредством PCIe-коммутации. Именно поэтому d-Matrix работает с GigaIO и Liqid. В одно шасси можно поместить восемь карт Corsair, а в стойку, которая будет потреблять порядка 6–7 кВт — 64 карты. d-Matrix уже разрабатывает ASIC следующего поколения Raptor, который должен выйти в 2026 году. Raptor будет ориентирован на «думающие» модели и получит ещё больше памяти за счёт размещения DRAM непосредственно поверх вычислительных чиплетов. SRAM-чиплеты Raptor также перейдут с 6-нм техпроцесса TSMC, который используется при изготовлении Corsair, к 4 нм без существенных изменений микроархитектуры. По словам компании, она потратила два года на работу с TSMC, чтобы создать 3D-упаковку для нового поколения ASIC. Как отмечает EETimes, команда разработчиков ПО d-Matrix в два раза больше команды разработчиков оборудования (120 против 60). Стратегия компании в области ПО заключается в максимальном использовании open source экосистемы, включая PyTorch, OpenAI Triton, MLIR, OpenBMC и т.д. Вместе они образуют программный стек Aviator, который отвечает за конвертацию моделей в числовые форматы d-Matrix, применяет к ним фирменные методы разрежения, компилирует их, распределяет нагрузку по картам и серверам, а также управляет исполнением моделей, включая обслуживание большого количества запросов.

27.12.2024 [17:36], Руслан Авдеев

YADRO выпустила первые четырёхсокетные серверы V240 G3Компания YADRO объявила о приёме заявок на демонстрационное тестирование четырёхпроцессорных серверов V240 G3 в форм-факторе 2U. Образцы, успешно протестированные в лаборатории, передадут до конца декабря одному из ключевых технологических партнеров. С января 2025 года YADRO начнет предоставлять демонстрационные платформы заказчикам на основе полученных запросов, сообщает пресс-служба компании. Выход первых четырёхпроцессорных серверов YADRO был анонсирован на конференции «Цифровая индустрия промышленной России» (ЦИПР-2024) в Нижнем Новгороде в мае 2024 года. Там был показан инженерный концепт новинки. Новые серверы YADRO V240 G3 обеспечат максимальную производительность благодаря четырём процессорам с поддержкой до 240 ядер и 16 Тбайт оперативной памяти. В модели доступно до 28 отсеков для SFF-накопителей, что обеспечивает гибкость настройки хранилища и высокую скорость ввода-вывода благодаря полной поддержке NVMe. Оптимизация TCO достигнута за счёт объединения вычислительных ресурсов двух двухпроцессорных серверов в единую компактную систему в форм-факторе 2U.

Источник изображения: YADRO Четырёхсокетные серверы YADRO V240 G3 предназначены для работы с наиболее ресурсоёмкими приложениями с высокими требованиями к вычислительным ресурсам: для виртуализации, высоконагруженных СУБД, аналитических и ERP-систем, электронной коммерции и банковских систем, а также обработки больших данных. Решение призвано стать оптимальным выбором для крупных финтех-компаний, бизнесов из сферы телекома, транспорта и логистики, промышленности и нефтегазовой индустрии. Все они ежедневно выполняют многопоточную обработку данных. По словам директора по продуктам YADRO Павла Егорова, серверы с четырьмя сокетами сегодня востребованы в различных отраслях, где требуются мощные вычислительные ресурсы. Они подходят для выполнения самых ресурсоемких задач в корпоративных и облачных системах, связанных с критическими данными, высокой нагрузкой и вертикальным масштабированием. По его словам, необходимо также отметить эффективную обработку пиковых нагрузок, которые гибко распределяются между процессорами, обеспечивая стабильность работы и сокращая время выполнения сложных задач.

17.12.2024 [12:30], Сергей Карасёв

1920 vCPU и 32 ТиБ RAM: AWS запустила инстансы EC2 U7inh на базе суперсерверов HPEОблачная платформа AWS объявила о доступности инстансов EC2 U7inh с сертификацией SAP. Эти экземпляры, построенные на серверах HPE, предлагают клиентам мощное и эффективное решение для запуска резидентных баз данных и приложений SAP в облаке. Задействована аппаратная платформа HPE Compute Scale-up Server 3200. Применяются серверы с 16 процессорами Intel Xeon Sapphire Rapids, насчитывающими до 60 вычислительных ядер каждый. Такие машины могут нести на борту до 32 Тбайт оперативной памяти DDR5. Допускается применение накопителей SATA/SAS HDD и SATA/SAS/NVMe SSD. Новые инстансы поддерживают Amazon Linux, Red Hat Enterprise Linux и SUSE Enterprise Linux Server. Сертификация SAP гарантирует, что экземпляры соответствуют строгим требованиям к производительности, объёму памяти и другим критическим характеристикам. Говорится о возможности использования SAP Business Suite on HANA (SoH), Business Suite S/4HANA, Business Warehouse on HANA (BW), SAP BW/4HANA. Несмотря на работу в виртуализированной среде, инстансы EC2 U7inh обеспечивают производительность, сопоставимую с bare metal.

Источник изображения: HPE Конфигурация EC2 U7inh включает 1920 vCPU и 32 768 ГиБ памяти DDR5. Пропускная способность сетевого подключения составляет 200 Гбит/с, пропускная способность EBS — 160 Гбит/с. Подчёркивается, что инстансы EC2 U7inh предоставляют заказчикам высоконадёжное решение для поддержки масштабных рабочих нагрузок SAP, гарантируя бесшовную интеграцию и работу в облачной инфраструктуре AWS. Более того, возможно даже объедиение четырёх инстансов в кластер, что в сумме даёт уже 7680 vCPU и 128 ТиБ RAM.

03.12.2024 [17:58], Сергей Карасёв

Delta Computers представила первый в России модульный восьмипроцессорный сервер Delta SpiderРоссийская компания Delta Computers анонсировала систему Delta Spider. Это, как утверждается, первый в РФ модульный восьмипроцессорный сервер на аппаратной платформе Intel Xeon Sapphire Rapids. В составе Delta Spider применяются чипы с 60 ядрами, значение TDP которых может достигать 385 Вт. Возможны конфигурации с двумя, четырьмя и восемью процессорами, что в сумме даёт до 480 ядер. Процессоры объединены шиной UPI. Поддерживается память DDR5-4400/4800, объём которой в максимальной конфигурации составляет 32 Тбайт (128 × 256 Гбайт). Доступны базовые варианты Spider L и Spider XL в формате 7OU и 13OU соответственно. Допускается установка соответственно 16 и 32 SSD типоразмера SFF (U.2; NVMe) толщиной 7 мм или 8 и 16 SSD толщиной 15 мм. В модуле управления предусмотрены ещё два посадочных места для SSD (U.2; NVMe) толщиной 7 мм. Версия Spider L располагает 12 слотами для карт PCIe 5.0 х16 HHHL, модификация Spider XL — 24 слотами. Серверы оборудованы гибридной системой охлаждения (вода+воздух) Delta Hybrid Cooling с возможность горячей замены вентиляторов, которая позволяет процессорам постоянно работать в Boost-режиме. Питание осуществляется от централизованного шинопровода OCP (12 В). Модуль управления наделён двумя портами USB 3.0, разъёмом 1GbE RJ-45, интерфейсами D-Sub и Mini-DP, а также сервисным портом USB Type-C. Применяется разработанное в России микропрограммное обеспечение Delta BIOS и Delta BMC. По заявлениям Delta Computers, платформа Delta Spider подходит для высоконагруженных приложений, таких как системы управления предприятием (ERP и CRM), автоматизированные банковские системы (ABS), аналитические сервисы принятия решений реального времени, биллинговые и платежные системы, а также иных in-memory приложений.

13.06.2024 [10:48], Сергей Карасёв

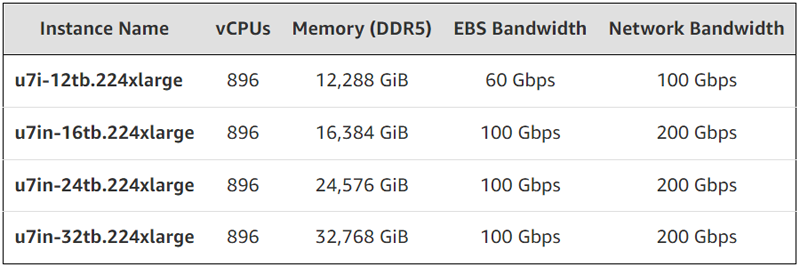

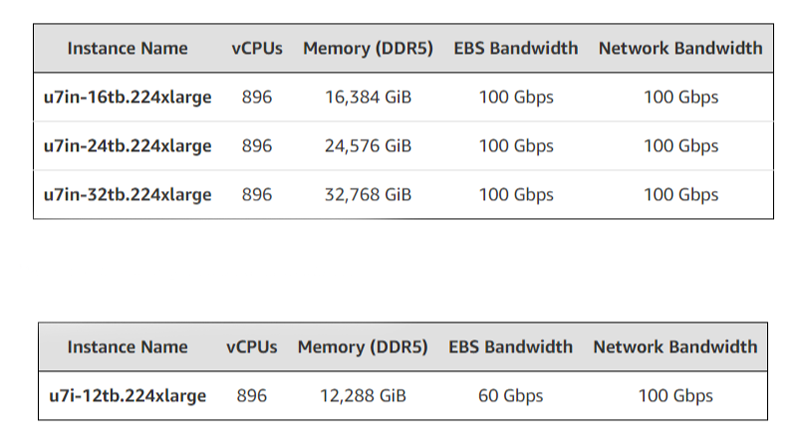

896 vCPU и 32 Тбайт памяти: AWS объявила о доступности сверхбольших инстансов EC2 U7iОблачная платформа Amazon Web Services (AWS) сообщила о доступности инстансов Elastic Compute Cloud (EC2) U7i, оптимизированных для резидентных (in-memory) баз данных. В основу положены кастомизированные процессоры Intel Xeon поколения Sapphire Rapids. Утверждается, что по сравнению с инстансами EC2 High Memory предыдущего поколения экземпляры U7i обеспечивают на 135 % более высокую вычислительную производительность и на 115 % большую производительность памяти. При этом пропускная способность EBS-томов увеличена в 2,5 раза. Инстансы поддерживают подключение до 128 томов EBS gp2/gp3 или io1/io2. Каждый том io2 Block Express может иметь размер до 64 ТиБ и обеспечивать производительность до 256 тыс. IOPS со скоростью до 32 Гбит/с. Все конфигурации включают 896 vCPU, а объём оперативной памяти варьируется от 12 288 до 32 768 ГиБ. Благодаря системе AWS Nitro вся память доступна для использования. Пропускная способность EBS составляет 60 Гбит/с у младшей версии и 100 Гбит/с у всех остальных. Пропускная способность сети — соответственно 100 и 200 Гбит/с.

Источник изображения: AWS Среди поддерживаемых ОС названы Amazon Linux, Red Hat Enterprise Linux, SUSE Linux Enterprise Server, Ubuntu и Windows Server. Говорится о возможности работы с крупными СУБД, в частности, SAP HANA, Oracle и SQL Server. Инстансы EC2 U7i были представлены в качестве предварительной версии в ноябре 2023 года. Теперь они доступны для клиентов в американских регионах AWS US East (Северная Вирджиния) и US West (Орегон), а также в Азиатско-Тихоокеанском регионе (Сеул, Сидней). Позднее в текущем году будут запущены более мощные инстансы с увеличенной вычислительной производительностью.

21.05.2024 [19:37], Сергей Карасёв

Российский сервер с четырьмя Intel Xeon Sapphire Rapids: Fplus представила платформу «Буран-SR242»

fplus

hardware

in-memory

intel

sapphire rapids

xeon

импортозамещение

марвел

россия

сделано в россии

сервер

Компания Fplus анонсировала первый, по её словам, российский сервер, поддерживающих установку четырёх процессоров. Система под названием «Буран-SR242» (SR-242E31-624T) предназначена для решения ИИ-задач, работы с большими данными, создания цифровых двойников, НРС-нагрузок и пр. Сервер выполнен в форм-факторе 2U на платформе Intel Xeon Sapphire Rapids. Каждый из четырёх процессоров (TDP до 350 Вт) может насчитывать до 60 ядер. Поддерживается до 16 Тбайт оперативной памяти DDR5 в виде 64 модулей. Во фронтальной части располагаются 24 отсека для SFF-накопителей SAS/SATA/NVMe, а сзади находятся ещё два посадочных места для SFF-устройств SATA. Кроме того, можно установить два модуля M.2 SATA/NVMe объёмом до 4 Тбайт каждый. Упомянута поддержка массивов RAID 0/1/10/1E/5/50/6/60. По заявлениям Fplus, новинка сконструирована так, чтобы заказчики могли легко интегрировать её в уже существующую IT-инфраструктуру. Четырехсокетное исполнение позволяет наращивать производительность постепенно и таким образом уменьшать размер первоначальных инвестиций, говорит компания. Кроме того, возможна установка двух двухслотовых карт расширения с TDP до 300 Вт. Слоты расширения выполнены по схеме 6 × PCIe 5.0 и 2 × PCIe 4.0. Есть выделенный порт PCIe 5.0 для карты OCP 3.0. Питание обеспечивают два блока с сертификатом Platinum мощностью до 2700 Вт. За охлаждение отвечают шесть вентиляторов диаметром 60 мм с резервированием N+1 и возможностью горячей замены. Диапазон рабочих температур простирается от 10 до +35 °C. Fplus полностью контролирует процесс разработки и производства сервера, а на площадке компании реализуются меры по повышению качества конечной продукции. Физические модули TPM 2.0 (Trust Platform Module) и TCM 2.0 (Trusted Cryptography Module) служат для хранения криптографических ключей, применяемых при обновлении внутреннего ПО. «Выпускать "Бураны" будут на нескольких площадках в России, в том числе на заводе Fplus в Подмосковье. Производственный процесс выстроен с учётом балльной системы локализации, чтобы в дальнейшем устройства вошли в реестр Минпромторга», — отмечает компания. Говорится также, что до сих пор в сегменте четырёхсокетных серверов доминировали зарубежные производители — почти все объёмы закрывались параллельным импортом. Системы с поддержкой четырёх процессоров также есть в ассортименте «DатаРу».

28.11.2023 [16:28], Владимир Мироненко

896 vCPU и 32 Тбайт RAM: AWS анонсировала самые крупные инстансы EC2 U7i для in-memory баз данныхОблачная платформа AWS представила инстансы Amazon EC2 U7i, предназначенные для поддержки крупных in-memory СУБД, включая SAP HANA, Oracle и SQL Server. Новые инстансы используют кастомные процессоры Intel Xeon Sapphire Rapids и обеспечивают по сравнению с инстансами EC2 High Memory первого поколения до 125 % большую вычислительную производительность и до 120 % большую производительность памяти. EC2 U7i также обеспечивают в 2,5 раза большую пропускную способность EBS-томов, позволяя наполнять базы данных in-memory со скоростью до 44 Тбайт/час. Инстанс U7i поддерживает подключение до 128 томов EBS gp2/gp3 или io1/io2. Каждый том io2 Block Express может иметь размер до 64 ТиБ и обеспечивать производительность до 256 тыс. IOPS со скоростью до 32 Гбит/с.  Инстансы поддерживают адаптеры ENA Express, обеспечивающем пропускную способность до 25 Гбит/с на каждый сетевой поток. Всего же каждый инстанс может получить 100-Гбит/с подключение для работы с сетью и EBS. Максимальная конфигурация включает 896 vCPU и 32768 ГиБ оперативной памяти. В число поддерживаемых U7i операционных систем входят Red Hat Enterprise Linux и SUSE Enterprise Linux Server. Инстансы U7i в виде превью доступны в регионах US West (Орегон), Азиатско-Тихоокеанском (Сеул) и Европейском (Франкфурт). |

|