Материалы по тегу: hpc

|

19.12.2024 [10:27], Сергей Карасёв

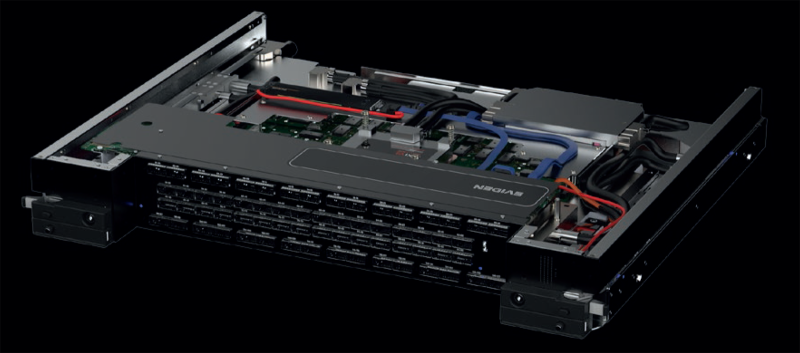

Стартап xAI начал монтаж суперускорителей NVIDIA GB200 NVL72 для ИИ-кластера ColossusСтартап xAI Илона Маска (Elon Musk), по сообщению ресурса ServeTheHome, приступил к расширению мощности ИИ-кластера Colossus. Речь идёт о монтаже суперускорителей NVIDIA GB200 NVL72 на архитектуре Blackwell. В начале сентября уходящего года компания xAI запустила ИИ-суперкомпьютер Colossus, в основу которого изначально легли 100 тыс. ускорителей NVIDIA H100. Сообщалось, что в дальнейшем количество ускорителей NVIDIA планируется увеличить вдвое. В начале декабря стартап получил $6 млрд инвестиций с целью увеличения числа ускорителей в составе Colossus до 1 млн штук. Отмечалось, что проект по расширению ИИ-кластера реализуется в партнёрстве с NVIDIA, Dell и Supermicro. Вместе с тем ранее появилась информация, что Dell перехватила у Supermicro крупный заказ на ИИ-серверы для xAI. Судя по всему, именно Dell является поставщиком систем GB200 NVL72 для комплекса Colossus. На днях специалист xAI Удай Руддарраджу (Uday Ruddarraju) опубликовал на своей странице в социальной сети Х фотографию новых серверных модулей в составе Colossus. На снимке видны вычислительные узлы и лотки с коммутаторами NVLink. Наблюдатели отмечают, что компоненты пока не подключены к основной сети, на что указывает отсутствие оптоволоконных соединений. Вместе с тем уже подсоединены низкоскоростные сети управления. В узлах установлены карты NVIDIA Bluefield-3. В отражении от шара с логотипом xAI просматриваются стойки с оборудованием. Предположительно, это системы производства Dell. Ранее глава этой компании Майкл Делл (Michael Dell) объявил о начале поставок первых в мире серверных стоек GB200 NVL72. Кроме того, Dell представила систему PowerEdge XE9712, которая использует архитектуру суперускорителя GB200 NVL72.

17.12.2024 [08:38], Руслан Авдеев

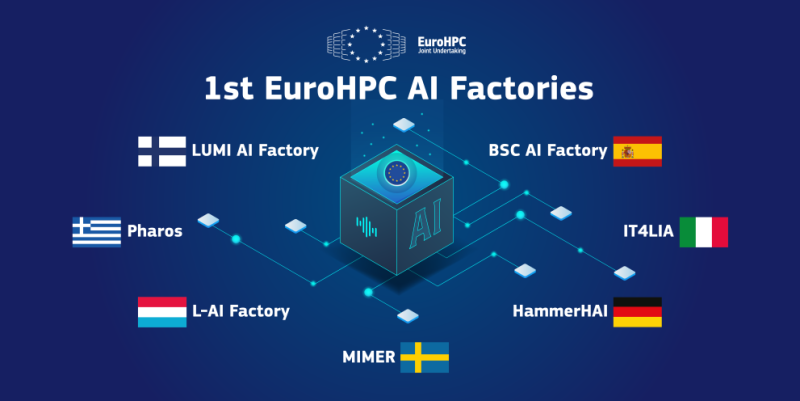

В 2025 году в Европе появится сразу семь ИИ-фабрик EuroHPC

eurohpc

hardware

hpc

llm

германия

греция

европа

евросоюз

ии

испания

италия

люксембург

суперкомпьютер

финляндия

швеция

Консорциум EuroHPC выбрал площадки для первых европейских ИИ-фабрик (AI Factory), которые появятся В 2025 году в Финляндии, Германии, Греции, Италии, Люксембурге, Испании и Швеции. Всего в проекте участвуют 17 стран. В Финляндии, Германии, Италии, Люксембурге и Швеции будут установлены новые ИИ-суперкомпьютеры. В Испании фабрика будет создана путём модернизации суперкомпьютера MareNostrum 5. В Греции фабрика будет связана с суперкомпьютером DAEDALUS, внедрение которого происходит сейчас. В Испании и Финляндии AI Factory будут включать в себя экспериментальную платформу, которая послужит передовой инфраструктурой для разработки и тестирования инновационных ИИ-моделей и приложений. Первые семь фабрик объединят как ресурсы отдельных стран, так и ресурсы ЕС в целом. Инициатива EuroHPC AI Factories призвана создать надёжную и взаимосвязанную сеть ИИ-хабов, которые предоставят ИИ-стартапам, малому и среднему бизнесу и исследователям комплексную поддержку, включая доступ к оптимизированным для ИИ и HPC ресурсам, обучению и техническому опыту. Финская ИИ-фабрика предложит передовую вычислительную платформу LUMI-AI и доступ к новым источникам данных, а также сервисному центру и кадровому резерву. Систему разместят в IT-центре CSC, расположенном в Каяани рядом с действующим суперкомпьютером LUMI. В консорциуме LUMI AI Factory помимо Финляндии участвуют Чехия, Дания, Эстония, Норвегия и Польша. В Германии на базе HammerHAI (Hybrid and Advanced Machine Learning Platform for Manufacturing, Engineering, And Research @ HLRS) будет создан единый центр для промышленности и академических кругов. Особое внимание будет уделяться барьерам, в настоящее время мешающим использовать ИИ стартапам и бизнеса. Новая облачная ИИ-платформа разместится в HPC-центре Штутгарта (HLRS) и будет создана при участии GWDG, BADW-LRZ, KIT и SICOS. HammerHAI обеспечит комплексную поддержку на протяжении всего цикла разработки ИИ, от обучения модели до инференса, а также поддержку пользователей и профессиональное образование. Также будут подготовлены базовые модели и наборы данных. Греческая ИИ-фабрика Pharos будет использовать суперкомпьютер DAEDALUS для решения задач Греции и ЕС в области здравоохранения, культуры и языка, а также устойчивого развития (энергетика, окружающая среда, климат). Предполагается комплексная поддержка пользователей, включая повышение квалификации, предоставление датасетов и обучение ИИ-моделей, а также поддержка бизнес-инноваций. Платформа будет управляться Национальной инфраструктурой исследований и технологий GRNET S.A. в Афинах, действующей под патронажем Министерства цифрового управления Греции. Особое внимание будет уделяться созданию ИИ-решений, соответствующих требованиям ЕС и отдельных индустрий. ИИ-фабрика IT4LIA, совместно создаваемая Италией, Австрией и Словенией, предоставит инфраструктуру ИИ и экосистему, которая объединит исследователей, разработчиков, стартапы и малый и средний бизнес. Это упростит доступ к ИИ-ресурсам государственным органам, студентам, учёным и бизнесу. Новая система будет сформирована в CINECA Consorzio Interuniversitario в Болонье как дополнение к суперкомпьютеру LEONARDO. ИИ-кластер производительностью более 40 Эфлопс (смешанная точность вычислений) будет в основном использоваться для внедрения ИИ в агросекторе, кибербезопасности, землепользовании и производстве. Люксембургу достанется L-AI Factory на базе ИИ-суперкомпьютера MeluXina-AI, который будет соседствовать с действующим суперкомпьютером MeluXina. Местная AI Factory призвана укрепить позиции страны в качестве европейского лидера в сфере ИИ. AI Factory обеспечит быструю адаптацию и персонализированную поддержку для всех предприятий, особенно стартапов и малого и среднего бизнеса. BSC AI Factory — совместная инициатива Испании, Португалии, Турции и Румынии, представленных Барселонским суперкомпьютерным центром (BSC-CNS), Фондом науки и технологий (FCT) и Советом научных и технологических исследований Турции (TÜBİTAK), и Национальным институтом исследований и разработок в области информатики (ICI, Бухарест). Система обеспечит внедрение ИИ в промышленности, стартапах, малом и среднем бизнесе и государственных организациях.

Источник изображения: BSC Фабрика ориентирована на услуги для государственного управления, здравоохранения, фармацевтики и биотехнологий, финансов и права, сельского хозяйства и климата, государственного сектора, энергетики, связи и средств массовой информации. В числе прочего предусмотрена модернизация суперкомпьютера MareNostrum 5 — BSC AI Factory станет частью Суперкомпьютерного центра Барселоны (BSC-CNS). Наконец, AI Factory MIMER будет организована Национальной академической суперкомпьютерной инфраструктурой (NAISS) Швеции в Университете Линчепинга в сотрудничестве с исследовательскими институтами Швеции (RISE). MIMER получит специализированный ИИ-суперкомпьютер среднего уровня, причём приоритет отдаётся облачному доступу и предоставление масштабного хранилища конфиденциальных данных. MIMER будет наращивать опыт использования ИИ в области естественных наук и здравоохранения, материаловедения, автономных систем и игровой индустрии. Проект будет сосредоточен на генеративных моделях в структурной биологии и разработке лекарств, персонализированной медицине и работе с международными партнёрами над разработкой базовых моделей следующего поколения, которые будут настроены для конкретных целей.

16.12.2024 [11:19], Сергей Карасёв

Раскрыты характеристики сетевых устройств Eviden с технологией BXI v3В ноябре текущего года компания Eviden (дочерняя структура Atos) представила интерконнект третьего поколения BullSequana eXascale Interconnect (BXI v3) для рабочих нагрузок ИИ и HPC. Теперь, как сообщает ресурс Next Platform, раскрыты некоторые характеристики устройств с поддержкой данной технологии. BXI v3 в качестве базового протокола связи использует Ethernet. Технология BXI v3 ляжет в основу интеллектуального сетевого адаптера (Smart NIC) и соответствующего коммутатора. Говорится, что для изготовления чипов ASIC с поддержкой BXI v3 компания Eviden рассматривает возможность применения 3-нм или 4-нм методики TSMC. Коммутатор BXI v3 располагает 64 портами, работающими на скорости 800 Гбит/с. Их можно переконфигурировать в 128 портов с пропускной способностью 400 Гбит/с. В свою очередь, адаптер Smart NIC функционирует на скорости 400 Гбит/с. Он будет предлагаться в виде двухслотовой карты расширения PCIe или OCP-3 (с интерфейсом PCIe 5.0). Возможны варианты адаптеров с двумя портами 400 Гбит/с. Карта BXI v3 способна управлять пакетами объёмом до 9 Мбайт, что полезно в нагруженных инфраструктурах ИИ. Платформа BXI v3 поддерживает топологии fat tree и dragonfly+, а также fat tree с оптимизацией маршрутов (используется при обучении больших языковых моделей). Для BXI v3 заявлена поддержка до 64 тыс. конечных точек, а задержка составляет менее 200 нс от порта к порту. Изделия с поддержкой BXI v3 поступит в продажу в 2025 году. Осенью 2027 года ожидается появление интерконнекта BXI v4, который предусматривает повышение пропускной способности портов на сетевых картах и коммутаторах до 1,6 Тбит/с. При этом сетевые адаптеры получат поддержку интерфейса PCIe 6.0. В 2029-м планируется переход на интерконнект BXI v5: он обеспечит скорость портов на коммутаторах до 3,2 Тбит/с, тогда как сетевые адаптеры продолжат работать на скоростях до 1,6 Тбит/с, но получат поддержку PCIe 7.0.

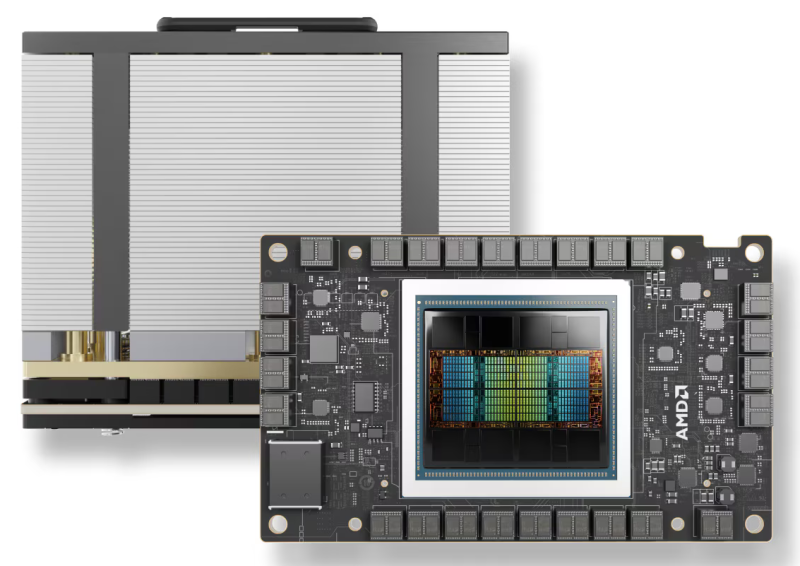

15.12.2024 [13:00], Сергей Карасёв

Vultr запустил облачный ИИ-кластер на базе AMD Instinct MI300XКрупнейший в мире частный облачный провайдер Vultr объявил о заключении соглашения о четырёхстороннем стратегическом сотрудничестве с целью развёртывания нового суперкомпьютерного кластера. В проекте принимают участие AMD, Broadcom и Juniper Networks. Применяются ускорители AMD Instinct MI300X и открытый программный стек ROCm. Данные о количестве ускорителей и общей производительности платформы пока не раскрываются. Кластер размещён в дата-центре Vultr Centersquare в Лайле (юго-западный пригород Чикаго; Иллинойс; США). Новая НРС-система построена с использованием Ethernet-коммутаторов Broadcom и оптимизированных для ИИ-задач сетевых Ethernet-решений Juniper Networks. Благодаря этим компонентам, как утверждается, возможно построение безопасной высокопроизводительной инфраструктуры. Кластер ориентирован прежде всего на обучение ИИ-моделей и ресурсоёмкие нагрузки инференса. «Сотрудничество с AMD, Broadcom и Juniper Networks позволяет предприятиям и специалистам в области ИИ использовать весь потенциал ускоренных вычислений при одновременном обеспечении гибкости, масштабируемости и безопасности», — говорит Джей Джей Кардвелл (J.J. Kardwell), генеральный директор Vultr. О доступности Instinct MI300X в своей облачной инфраструктуре компания Vultr сообщила в сентябре нынешнего года. Ускорители AMD интегрируются с Vultr Kubernetes Engine for Cloud GPU для формирования кластеров Kubernetes, использующих ускорители. Предложение ориентировано на задачи ИИ и НРС. Vultr ставит своей целью сделать высокопроизводительные облачные вычисления простыми в использовании и доступными для предприятий и разработчиков по всему миру. На сегодняшний день экосистема Vultr включает 32 облачные зоны, в том числе площадки в Северной Америке, Южной Америке, Европе, Азии, Австралии и Африке.

14.12.2024 [15:25], Сергей Карасёв

HPE создаст HPC-систему Blue Lion для Суперкомпьютерного центра имени ЛейбницаСуперкомпьютерный центр имени Лейбница (LRZ) в Германии, управляемый Баварской академией наук в Мюнхене (BADW), объявил о подписании соглашения с HPE на строительство HPC-комплекса нового поколения. Проект получил название Blue Lion. LRZ, входящий в состав Суперкомпьютерный центр имени Гаусса (GCS), намерен запустить систему Blue Lion в 2027 году. Предполагается, что комплекс не только ускорит выполнение задач в области классического моделирования, но и откроет новые возможности для достижений в сфере ИИ. В основу Blue Lion ляжет платформа HPE Cray нового поколения с ускорителями NVIDIA. Говорится о применении интерконнекта HPE Slingshot с пропускной способностью до 400 Гбит/с. По производительности Blue Lion примерно в 30 раз превзойдёт предшественника — систему SuperMUC-NG, которая обеспечивает теоретическое пиковое быстродействие в 26,9 Пфлопс.

Источник изображения: GCS Blue Lion будет использовать на 100 % прямое жидкостное охлаждение тёплой водой температурой до +40 °C, протекающей по медным трубкам. Нагретую воду планируется повторно использовать для отопления помещений самого LRZ, а также соседних учреждений в Гархинге. Утверждается, что такая СЖО расходует примерно на 94 % меньше энергии в процессе работы, чем сопоставимая по классу система воздушного охлаждения. Blue Lion также потребует значительно меньше места для размещения благодаря более высокой плотности монтажа. Проект Blue Lion в равных долях финансируется Министерством науки и искусства Баварии (StMWK) и Федеральным министерством образования и исследований (BMBF). Затраты на создание суперкомпьютера оцениваются в €250 млн с учётом эксплуатационных расходов до 2032 года.

09.12.2024 [20:17], Руслан Авдеев

Канада потратит $2 млрд на ИИ ЦОД и суперкомпьютерыМинистр инноваций, науки и промышленности Канады Франсуа-Филипп Шампань (François-Philippe Champagne) официально заявил о старте реализации Канадской стратегии суверенных ИИ-вычислений (Canadian Sovereign AI Compute Strategy). Она предусматривает выделение до $2 млрд, сообщает HPC Wire. Предполагается, что стратегия будет способствовать достижению трёх ключевых целей:

Публичные консультации, посвящённые стратегии, проводились летом 2024 года. Были получены отзывы от более чем 1 тыс. заинтересованных сторон, в том числе от представителей науки, промышленности, общественности и др. Кроме того, власти страны приняли ряд мер по ответственному созданию и внедрению ИИ в экономику Канады, сформировав Канадский институт безопасности ИИ, подготовив Закон об искусственном интеллекте и данных (законопроект C-27) и предложив Добровольный кодекс ответственной разработки и управления передовыми системами генеративного ИИ. Все $2 млрд выделят из государственного бюджета 2024 года в рамках стратегии, удовлетворяющей кратко-, средне- и долгосрочные потребностям исследователей и разработчиков в ИИ-вычислениях. До $700 млн получат представители промышленности, академических кругов и бизнеса, занимающиеся созданием канадских ИИ ЦОД. Среди заявок на финансирование приоритет будет отдаваться высокомаржинальным проектам. До $1 млрд выделят на создание суверенной суперкомпьютерной инфраструктуры, а также безопасного ЦОД. До $300 млн выделят в Фонд доступа к ИИ-вычислениям, более подробная информация котором появится после официального старта программы весной 2025 года. В 2022–2023 гг. количество специалистов в стране выросло на 29 %, достигнув 140 тыс., причём по скорости прироста Канада занимает первое место среди стран «Большой семёрки» (G7). В Канаде работают 10 % ведущих мировых исследователей систем искусственного интеллекта. С 2019 года она также занимет первое место среди стран G7 по количеству посвящённых ИИ научных статей на душу населения. А количество поданных канадскими изобретателями патентов в области ИИ в 2022–2023 гг. увеличилось на 57 %.

08.12.2024 [23:32], Сергей Карасёв

Юлихский суперкомпьютерный центр получил 100-кубитный квантовый компьютер PasqalКомпания Pasqal поставила в Юлихский суперкомпьютерный центр в Германии (JSC) 100-кубитный квантовый компьютер на нейтральных атомах. Установка системы выполнена в рамках проекта HPCQS, реализуемого Европейским совместным предприятием по развитию высокопроизводительных вычислений (EuroHPC JU). Инициатива HPCQS (High Performance Computer and Quantum Simulator hybrid) нацелена на интеграцию квантовых систем с европейской инфраструктурой суперкомпьютеров. Это, как ожидается, позволит создать мощную вычислительную платформу для решения сложных задач в различных областях, таких как здравоохранение, энергетика, автомобилестроение, финансы, торговля и кибербезопасность. Проект HPCQS поддерживается предприятием EuroHPC JU и шестью европейскими странами — Австрией, Францией, Германией, Ирландией, Италией и Испанией. Новая система станет частью Унифицированной инфраструктуры квантовых вычислений Юлиха (Jülich UNified Infrastructure for Quantum Computing, JUNIQ). Система Pasqal использует нейтральные атомы для формирования кубитов. Такие атомы не имеют электрического заряда, благодаря чему слабо взаимодействуют с внешними электромагнитными полями — это позволяет улучшить стабильность. Атомы захватываются и манипулируются с помощью лазера, что даёт возможность проводить высокоточные квантовые операции. Кроме того, системы на базе нейтральных атомов относительно просто масштабируются. В JSC комплекс Pasqal будет сопряжён с суперкомпьютером JURECA DC. Квантовый компьютер планируется применять для выполнения сложного моделирования в физике и химии, а также для квантового машинного обучения. Нужно отметить, что весной нынешнего года JSC получил 5-кубитную систему Spark немецко-финского производителя IQM Quantum Computers. Кроме того, ранее консорциум EuroHPC объявило о планах по созданию двух дополнительных квантовых компьютеров.

06.12.2024 [17:05], Владимир Мироненко

xAI получил ещё $6 млрд инвестиций и приступил к расширению ИИ-кластера Colossus до 1 млн ускорителейСтартап xAI, курируемый Илоном Маском (Elon Musk), планирует на порядок расширить свой ИИ-кластер Colossus в Мемфисе (Теннесси, США), включающий в настоящее время 100 тыс. NVIDIA H100. Как пишет HPCwire, об этом заявил Брент Майо (Brent Mayo), старший менеджер xAI по строительству объектов и инфраструктуры. По словам Майо, стартап уже приступил к работам по расширению ИИ-кластера до не менее чем 1 млн ускорителей совместно с NVIDIA, Dell и Supermicro. Для содействия проекту xAI была создана оперативная группа под руководством главы Торговой палаты Мемфиса Теда Таунсенда (Ted Townsend), готовая оказать помощь в решении проблем в любое время суток. Проект знаменует собой крупнейшее капиталовложение в истории региона. Заявление о старте работ над расширением ИИ-кластера последовало после появления сообщений о том, что xAI удалось привлечь ещё $6 млрд инвестиций. Новые вливания могут увеличить оценку рыночной стоимости стартапа до $50 млрд. Точные цифры будут объявлены немного позже. Colossus используется для обучения моделей ИИ для чат-бота Grok, разработанного xAI, который уступает по возможностям и аудитории лидеру рынка OpenAI ChatGPT, а также Google Gemini. Стартап выпустил свою первую большую языковую модель Grok-1 в конце 2023 года, в апреле 2024 года вышла модель Grok-1.5, а Grok-2 — в августе. Colossus был построен в рекордные сроки — всего за три месяца. Гендиректор NVIDIA, Дженсен Хуанг (Jensen Huang), заявил, что «в мире есть только один человек, который мог бы это сделать». Хуанг назвал Colossus «несомненно самым быстрым суперкомпьютером на планете, если рассматривать его как один кластер», отметив, что ЦОД такого размера обычно строится три года. Активисты из числа жителей Мемфиса раскритиковали проект из-за повышенной нагрузки на местные энергосети и требований, которые ИИ-кластер предъявляет к региональной энергосистеме. «Мы не просто лидируем; мы ускоряем прогресс беспрецедентными темпами, обеспечивая при этом стабильность энергосети, используя Megapack», — заявил в ответ Брент Майо на мероприятии в Мемфисе, пишет Financial Times.

06.12.2024 [16:42], Сергей Карасёв

iGenius анонсировала Colosseum — один из мощнейших в мире ИИ-суперкомпьютеров на базе NVIDIA DGX GB200 SuperPodКомпания iGenius, специализирующаяся на ИИ-моделях для отраслей со строгим регулированием, анонсировала вычислительную платформу Colosseum. Это, как утверждается, один из самых мощных в мире ИИ-суперкомпьютеров на платформе NVIDIA DGX SuperPOD с тысячами ускорителей GB200 (Blackwell). Известно, что комплекс Colosseum располагается в Европе. Полностью характеристики суперкомпьютера не раскрываются. Отмечается, что он обеспечивает производительность до 115 Эфлопс на операциях ИИ (FP4 с разреженностью). Говорится о применении передовой системы жидкостного охлаждения. Для питания используется энергия из возобновляемых источников в Италии. По информации Reuters, в состав Colosseum войдут около 80 суперускорителей GB200 NVL72. Таким образом, общее количество ускорителей Blackwell достигает 5760. Общее энергопотребление системы должно составить почти 10 МВт. Стоимость проекта не называется. Но глава iGenius Ульян Шарка (Uljan Sharka) отмечает, что компания в течение 2024 года привлекла на развитие примерно €650 млн и намерена получить дополнительное финансирование для проекта Colosseum. При этом подчёркивается, что iGenius — один из немногих стартапов в области ИИ в Европе, капитализация которого превышает $1 млрд. iGenius планирует применять Colosseum для ресурсоёмких приложений ИИ, включая обучение больших языковых моделей (LLM) с триллионом параметров, а также работу с открытыми моделями генеративного ИИ. Подчёркивается, что создание Colosseum станет основой для следующего этапа сотрудничества между iGenius и NVIDIA в области ИИ для поддержки задач, требующих максимальной безопасности данных, надёжности и точности: это может быть финансовый консалтинг, обслуживание пациентов в системе здравоохранения, государственное планирование и пр. Модели iGenius AI, созданные с использованием платформы NVIDIA AI Enterprise, NVIDIA Nemotron и фреймворка NVIDIA NeMo, будут предлагаться в виде микросервисов NVIDIA NIM. По заявлениям iGenius, Colosseum поможет удовлетворить растущие потребности в ИИ-вычислениях. Colosseum также будет служить неким хабом, объединяющим предприятия, академические учреждения и государственные структуры. Нужно отметить, что около месяца назад компания DeepL, специализирующаяся на разработке средств автоматического перевода на основе ИИ, объявила о намерении развернуть платформу на базе NVIDIA DGX GB200 SuperPod в Швеции. DeepL будет применять этот комплекс для исследовательских задач, в частности, для разработки передовых ИИ-моделей.

05.12.2024 [16:14], Сергей Карасёв

Запущен британский Arm-суперкомпьютер Isambard 3 с суперчипами NVIDIA GraceВ Великобритании введён в эксплуатацию суперкомпьютер Isambard 3, предназначенный для ресурсоёмких приложений ИИ и задач НРС. Реализация проекта обошлась приблизительно в £10 млн, или примерно $12,7 млн. Машина пришла на смену комплексу Isambard 2, который отправился на покой в сентябре нынешнего года. Система Isambard 3 создана в рамках сотрудничества между исследовательским консорциумом GW4 Alliance, в который входят университеты Бата, Бристоля, Кардиффа и Эксетера, а также компаниями HPE, NVIDIA и Arm. Суперкомпьютер назван в честь британского инженера Изамбарда Кингдома Брюнеля, внесшего значимый вклад в Промышленную революцию. Полностью технические характеристики Isambard 3 не раскрываются. Известно, что в основу машины положены 384 суперпроцессорами NVIDIA Grace со 144 ядрами (2 × 72) Arm Neoverse V2 (Demeter), общее количество которых превышает 55 тыс. Задействована высокопроизводительная СХД HPE, которая обеспечивает расширенные IO-возможности с интеллектуальным распределением данных по нескольким уровням. Благодаря этому достигается эффективная обработка задач с интенсивным использованием информации, таких как обучение моделей ИИ. Известно также, что в составе комплекса применяется фирменный интерконнект HPE Slingshot, а в качестве внутреннего интерконнекта служит технология NVLink-C2C, которая в семь раз быстрее PCIe 5.0. Каждый узел суперкомпьютера содержит один суперчип Grace и сетевой адаптер Cassini с пропускной способностью до 200 Гбит/с. Объём системной памяти составляет 2 × 120 Гбайт (240 Гбайт). Отмечается, что Isambard 3 демонстрирует в шесть раз более высокую производительность и в шесть раз лучшую энергоэффективность по сравнению с Isambard 2. Пиковое быстродействие FP64 у Isambard 3 достигает 2,7 Пфлопс при энергопотреблении менее 270 кВт. Применять новый суперкомпьютер планируется для таких задач, как проектирование оптимальной конфигурации ветряных электростанций на суше и воде, моделирование термоядерных реакторов, исследования в сфере здравоохранения и пр. Суперкомпьютер расположен в автономном дата-центре с системой самоохлаждения HPE Performance Optimized Data Center (POD) в Национальном центре композитов в Научном парке Бристоля и Бата. Там же ведётся монтаж ИИ-комплекса Isambard-AI стоимостью £225 млн ($286 млн), который должен стать самым быстрым и мощным суперкомпьютером в Великобритании. Проект Isambard-AI реализуется в несколько этапов. Первая фаза предполагает монтаж 42 узлов, каждый из которых несёт на борту четыре суперчипа NVIDIA GH200 Grace Hopper и 4 × 120 Гбайт памяти для CPU (доступно 460 Гбайт — по 115 Гбайт на CPU), а также 4 × 96 Гбайт памяти для GPU (H100). В ходе второй фазы будут добавлены 1320 узлов, насчитывающих в сумме 5280 суперчипов NVIDIA GH200 Grace Hopper. Кроме того, в состав Isambard 3 входит экспериментальный x86-модуль MACS (Multi-Architecture Comparison System), включающий сразу восемь разновидностей узлов на базе процессоров AMD EPYC и Intel Xeon нескольких поколений, часть из них также имеет ускорители AMD Instinct MI100 и NVIDIA H100/A100. Все они объединены 200G-интерконнектом HPE Slingshot. |

|