Материалы по тегу: nvidia

|

04.11.2024 [13:05], Сергей Карасёв

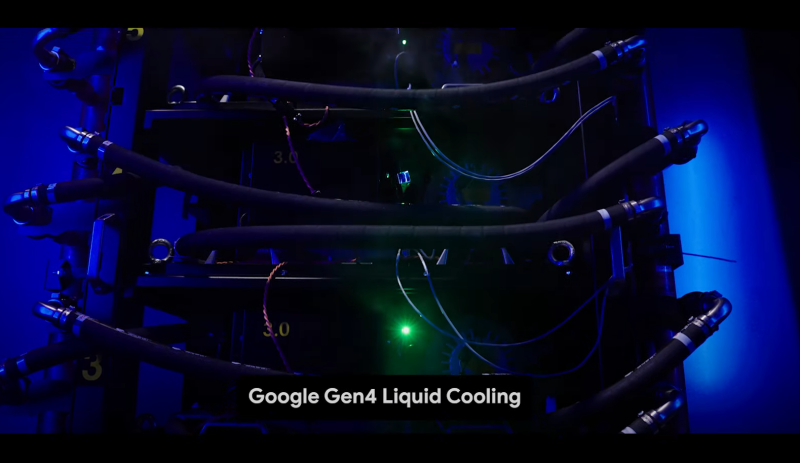

DeepL развернёт в Швеции ИИ-платформу на базе NVIDIA DGX GB200 SuperPod, чтобы «разрушить языковые барьеры»Компания DeepL объявила о намерении развернуть вычислительный комплекс на платформе NVIDIA DGX SuperPOD с ускорителями GB200. Система расположится на площадке EcoDataCenter в Швеции, а её ввод в эксплуатацию запланирован на середину 2025 года. DeepL специализируется на разработке средств автоматического перевода на основе ИИ. По заявлениям Ярека Кутыловски (Jarek Kutylowski), генерального директора и основателя DeepL, компания создала решение, которое по точности перевода превосходит все другие сервисы на рынке. Более 100 тыс. предприятий, правительственных структур и других организаций, а также миллионы индивидуальных пользователей по всему миру применяют языковые ИИ-инструменты DeepL. Штат компании насчитывает более 1 тыс. сотрудников. Её поддерживают инвестициями Benchmark, IVP, Index Ventures и др. В 2023 году DeepL развернула суперкомпьютер Mercury на базе NVIDIA DGX SuperPOD с ускорителями H100. В июньском рейтинге TOP500 эта система занимает 41-е место с FP64-производительностью 21,85 Пфлопс и теоретическим пиковым быстродействием 33,85 Пфлопс. Платформа NVIDIA DGX SuperPOD с ускорителями GB200 предусматривает использование жидкостного охлаждения. Возможно масштабирование до десятков тысяч ускорителей. DeepL намерена применять новый комплекс для исследовательских задач — в частности, для разработки передовых ИИ-моделей, которые позволят ещё больше расширить возможности средств перевода между различными языками. Это позволит «разрушить языковые барьеры для предприятий и профессионалов по всему миру», обещает компания.

03.11.2024 [12:15], Сергей Карасёв

Google Cloud представила инстансы A3 Ultra с ускорителями NVIDIA H200 и готовится развернуть суперускорители GB200 NVL72Компания Google объявила о том, что в составе её облачной платформы в скором времени станут доступны инстансы A3 Ultra на базе ускорителей NVIDIA H200. Новые виртуальные машины предназначены для ресурсоёмких нагрузок, связанных с ИИ, включая обучение больших языковых моделей (LLM). Напомним, в августе 2023 года Google анонсировала инстансы A3 с ускорителями NVIDIA H100. Позднее дебютировали виртуальные машины A3 Mega с поддержкой конфиденциальных вычислений. А до конца текущего месяца клиенты получат доступ к A3 Ultra со значительно более высокой производительностью. Представленные инстансы построены на серверах с новыми DPU Titanium ML, оптимизированными для высокопроизводительных облачных рабочих нагрузок ИИ. Заявленная пропускная способность RDMA-соединений GPU↔GPU достигает 3,2 Тбит/с (RoCE). Задействована фирменная платформа Google Jupiter с оптической коммутацией. По сравнению с A3 Mega виртуальные машины A3 Ultra обеспечивают следующие преимущества:

Инстансы A3 Ultra будут доступны через Google Kubernetes Engine (GKE). Кроме того, виртуальные машины войдут в состав Hypercompute Cluster — специализированной платформы, объединяющей передовые ИИ-технологии Google Cloud. Отмечается также, что в начале 2025 года Google развернёт системы на базе NVIDIA GB200 NVL72. Ранее Google демонстрировала собственный вариант этого суперускорителя.

02.11.2024 [12:04], Руслан Авдеев

ParTec обвинила NVIDIA и Microsoft в нарушении патентов на ИИ-суперкомпьютерыНемецкий разработчик и интегратор HPC-решений ParTec выступил с иском к NVIDIA, обвинив последнюю в нарушении патентных прав. По данным The Register, компания требует запретить продажи ускорителей NVIDIA в 18 странах, участвующих в общей для ЕС патентной системе. ParTec, принимающая участие в создании первой в Европе экзафлопсной машины JUPITER и других суперкомпьютеров вроде MareNostrum5, подтвердила, что предметом спора явояются те же самые патенты, из-за которых Partec уже подала иск против Microsoft в США. Впрочем, не исключено, что ParTec намерена добиваться не запрета продаж, а подписания с NVIDIA лицензионного договора — иначе блокировка сбыта в Европе ускорителей NVIDIA может повлиять на реализацию проектов с участием самой ParTec. Оба иска касаются патентов, связанных с динамической модульной системной архитектурой (dMSA). Именно она имеет важнейшее значение для построения высокопроизводительных вычислительных кластеров и обеспечивает оптимальное взаимодействие CPU, GPU и прочей электроники в составе систем, применяемых как для обучения ИИ-моделей, так и для инференса. Ранее в ParTec сообщали, что Microsoft незаконно использовала именно эту интеллектуальную собственность при создании облачной платформы Azure AI.

Источник изображения: Tingey Injury Law Firm/unsplash.com Иск к NVIDIA ParTec и её лицензионный агент BF exaQC AG подали в Единый патентный суд Евросоюза 27 октября. В ParTec намерены добиваться запрета для NVIDIA распространять свои ускорители в странах Евросоюза, в которых действуют патенты, а также возмещения ущерба. По имеющимся данным, речь идёт о патентах EP2628080 и EP3743812, причём последний действует во всех странах ЕС, являющихся частью Единой патентной системы. Речь идёт о 18 государствах, в том числе Германии, Франции и Италии. Если истцы выиграют суд, продажа ряда продуктов NVIDIA в этих странах будет запрещена. В компании утверждают, что давно предвидели перспективы ПО для масштабирования вычислений, поэтому и занялись разработкой dMSA. Компания также утверждает, что вела переговоры с NVIDIA, продемонстрировав свою модульную архитектуру, ПО ParaStation и ключевые патенты. NVIDIA якобы проявила большой интерес к технологии и даже объявила о готовности разрабатывать суперкомпьютеры с использованием ParaStation, но впоследствии эти планы так и не были реализованы. Сейчас компании так или иначе сотрудничают над созданием других суперкомпьютеров, где NVIDIA выступает «предпочтительным поставщиком» ускорителей для ЦОД. В ParTec заявили, что иск был неизбежен, поскольку NVIDIA отказалась вести переговоры о поставках ускорителей. Последняя якобы поступила так из-за иска ParTec к Microsoft — одного из ключевых клиентов NVIDIA. В ParTec подчёркивают, что благодаря её технологиям Германия и Европа в целом получат возможность развить собственную «суверенную индустрию». Однако мир сегодня зависит от нарушителей патентов, т.е. NVIDIA и Microsoft, распространяющих решения, представляющие угрозу для Германии и европейской IT-индустрии, говорит ParTec.

01.11.2024 [11:14], Сергей Карасёв

Марк Цукерберг: для обучения ИИ-модели Llama-4 используются более 100 тыс. ускорителей NVIDIA H100Председатель правления и генеральный директор Meta✴ Марк Цукерберг (Mark Zuckerberg), по сообщению ресурса Tom's Hardware, раскрыл масштабы кластера, который используется для обучения ИИ-модели нового поколения Llama-4. По его словам, для этих целей задействованы более 100 тыс. ускорителей NVIDIA H100. Напомним, в начале сентября нынешнего года стартап xAI, курируемый Илоном Маском (Elon Musk), объявил о запуске ИИ-суперкомпьютера Colossus, в основу которого положены 100 тыс. штук H100. В дальнейшем количество ускорителей в составе Colossus планируется увеличить вдвое. Теперь об эксплуатации кластера схожего масштаба рассказал Цукерберг. Глава Meta✴ не стал вдаваться в подробности о характеристиках Llama-4, ограничившись лишь фразами вроде «новые модальности», «более сильные рассуждения» и «повышенное быстродействие». Ранее Meta✴ заявляла о намерении потратить в 2024-м от $30 млрд до $37 млрд на развитие своей инфраструктуры — прежде всего для задач ИИ. Кроме того, говорилось, что к концу текущего года компания рассчитывает оперировать мощностями, эквивалентными более чем 500 тыс. ускорителей NVIDIA H100.

Источник изображения: Meta✴ Вместе с тем, как отмечается, возникают сложности при обеспечении питанием столь масштабных ИИ-кластеров. Дело в том, что один современный GPU может потреблять до 3,7 МВт·ч электроэнергии в год. Это означает, что массив из 100 тыс. таких ускорителей потребует не менее 370 ГВт·ч в год, чего достаточно для обеспечения энергией более 34 млн среднестатистических американских домохозяйств. Цукерберг признаёт, что трудности, связанные с доступностью энергоресурсов, в перспективе могут ограничить темпы роста отрасли ИИ. Как добавляет ComputerWeekly, Meta✴ также отказалась от практики увеличения срока службы серверов с целью сокращения расходов. Ранее компания сообщила о продлении периода эксплуатации оборудования до пяти лет вместо прежних четырёх с половиной: это, как ожидалось, даст экономию в $1,5 млрд. Однако теперь финансовый директор Meta✴ Сьюзан Ли (Susan Li) заявила, что компания в свете стремительного развития ИИ намерена применять серверы последнего поколения, чтобы максимально эффективно использовать доступную ёмкость существующих дата-центров.

31.10.2024 [11:33], Сергей Карасёв

Cisco представила ИИ-сервер UCS C885A M8 на базе NVIDIA H100/H200 или AMD Instinct MI300XКомпания Cisco анонсировала сервер высокой плотности UCS C885A M8, предназначенный для решения задач в области ИИ, таких как обучение больших языковых моделей (LLM), тонкая настройка моделей, инференс, RAG и пр. Устройство выполнено в форм-факторе 8U. В зависимости от модификации устанавливаются два процессора AMD EPYC 9554 поколения Genoa (64 ядра; 128 потоков; 3,1–3,75 ГГц; 360 Вт) или два чипа EPYC 9575F семейства Turin (64 ядра; 128 потоков; 3,3–5,0 ГГц; 400 Вт). Доступны 24 слота для модулей DDR5-600 суммарным объёмом 2,3 Тбайт. В максимальной конфигурации могут быть задействованы восемь SXM-ускорителей NVIDIA H100, H200 или AMD Instinct MI300X. Каждый ускоритель дополнен сетевым адаптером NVIDIA ConnectX-7 или NVIDIA BlueField-3 SuperNIC. Кроме того, в состав сервера входит DPU BlueField-3. Слоты расширения выполнены по схеме 5 × PCIe 5.0 x16 FHHL плюс 8 × PCIe 5.0 x16 HHHL и 1 × OCP 3.0 PCIe 5.0 x8 (для карты X710-T2L 2x10G RJ45 NIC). Новинка оборудована загрузочным SSD вместимостью 1 Тбайт (M.2 NVMe), а также 16 накопителями U.2 NVMe SSD на 1,92 Тбайт каждый. Установлены два блока питания мощностью 2700 Вт и шесть блоков на 3000 Вт с возможностью горячей замены. Cisco также представила инфраструктурные стеки AI POD, адаптированные для конкретных вариантов использования ИИ в различных отраслях. Они объединяют вычислительные узлы, сетевые компоненты, средства хранения и управления. Стеки, как утверждается, обеспечивают хорошую масштабируемость и высокую эффективность при решении ИИ-задач.

30.10.2024 [12:00], Сергей Карасёв

NVIDIA представила эталонные архитектуры для корпоративных ИИ-фабрикКомпания NVIDIA анонсировала инициативу Enterprise Reference Architectures (Enterprise RA), в рамках которой партнёры и заказчики смогут использовать эталонные архитектуры для построения собственных ИИ-платформ корпоративного уровня, рассчитанных на ресурсоёмкие нагрузки. NVIDIA отмечает, что на фоне перехода от вычислений общего назначения к ускоренным вычислениям предприятия сталкиваются с различными трудностями при проектировании и развёртывании инфраструктуры ЦОД. Это затрудняет разработку долгосрочных стратегий и снижает эффективность инвестиций. Инициатива Enterprise RA призвана решить проблемы. Эталонные архитектуры Enterprise RA помогут организациям минимизировать ошибки при проектировании так называемых фабрик ИИ (дата-центров для задач ИИ), предоставляя комплексные рекомендации по аппаратному и программному обеспечению, а также подробные указания по оптимальным конфигурациям серверов, кластеров и сетей. В результате клиенты смогут снизить затраты и сократить время, необходимое для построения вычислительной ИИ-инфраструктуры нового поколения. Среди преимуществ предлагаемого подхода названы масштабируемость и управляемость, высокий уровень безопасности (применяется принцип нулевого доверия), оптимальная производительность, снижение сложности систем и ускоренный выход на рынок. Эталонные архитектуры спроектированы таким образом, чтобы их можно было легко модернизировать в будущем. Говорится о совместимости с различными сторонними аппаратными и программными компонентами, но в перечень рекомендаций входят прежде всего решения самой NVIDIA, включая:

Решения на базе NVIDIA Enterprise RA будут предлагаться партнёрами NVIDIA, включая Dell, НРЕ, Lenovo и Supermicro.

29.10.2024 [20:28], Сергей Карасёв

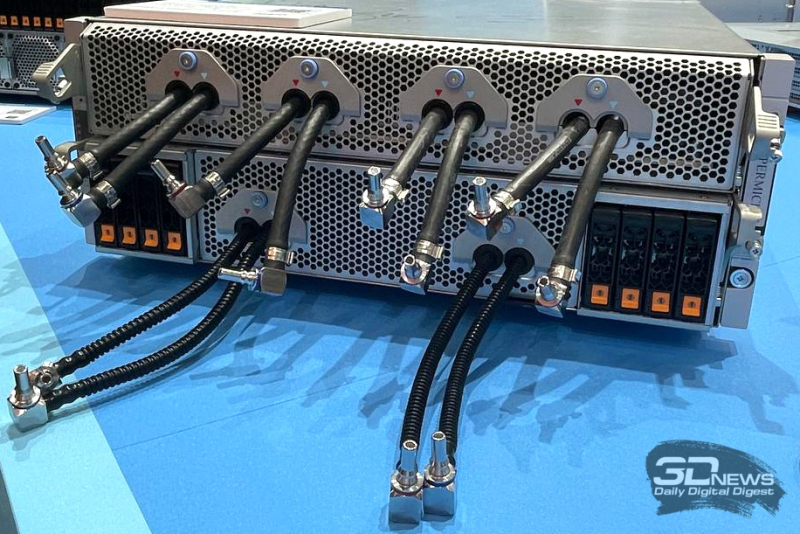

Раскрыты подробности архитектуры ИИ-кластера xAI Colossus со 100 тыс. ускорителей NVIDIA H100Портал ServeTheHome рассказал подробности об архитектуре вычислительного кластера xAI Colossus, предназначенного для обучения крупных ИИ-моделей. Эта система использует 100 тыс. NVIDIA H100, а в дальнейшем количество ускорителей планируется увеличить вдвое. Это самый крупный из известных ИИ-кластеров на текущий момент. Оборудование для него поставили компании Dell и Supermicro. Стартап xAI, курируемый Илоном Маском (Elon Musk), объявил о запуске суперкомпьютера Colossus в начале сентября нынешнего года. Утверждается, что на создание системы потребовалось всего 122 дня. Причём с момента установки первой стойки с серверами до начала обучения ИИ-моделей прошло только 19 суток. Впрочем, как отмечают эксперты, поскольку машина является «однозадачной», т.е. в отличие от традиционных суперкомпьютеров предназначенной только для работы с ИИ, ускорить строительство было не так уж сложно, хотя результат всё равно впечатляющий. Как сообщается, в составе Colossus применены серверы на платформе NVIDIA HGX H100, оборудованные системой жидкостного охлаждения. Каждый узел Supermicro серии TNHR2-LCC типоразмера 4U содержит восемь ускорителей NVIDIA H100 и два CPU. Узел разделён на две половинки, одна с CPU и PCIe-коммутаторами и одна с HGX-платой, которые могут извлекаться независимо для простоты обслуживания. CPU, коммутаторы и ускорители охлаждаются посредством СЖО. Вентиляторы в шасси тоже есть. Воздух от них попадает на теплообменники на задней двери, которые уносят остаточное тепло. Холодных и горячих коридоров в ЦОД нет, воздух имеет одинаковую температуру во всём зале. В нижней части стоек располагается ещё один 4U-блок Supermicro для CDU с резервированием и поддержкой горячей заменой насосов. Каждый сервер имеет четыре блока питания с резервированием и возможностью горячей замены, которые подключены к трёхфазным PDU. Одна стойка объединяет восемь узлов NVIDIA HGX H100, между которыми располагаются коллекторы СЖО в формате 1U. Таким образом, каждая стойка насчитывает 64 экземпляра H100. Стойки организованы в группы по восемь штук, которые образуют малые кластеры из 512 ускорителей H100. Они в свою очередь объединены в т.н. «острова» по 25 тыс. ускорителей, каждому из которых полагается собственный машинный зал. Общее количество стоек в составе Colossus превышает 1500. Помимо узлов с ускорителями также есть CPU-узлы и узлы хранения All-Flash (1U). Как отмечает NVIDIA, в кластере Colossus задействована сетевая платформа Spectrum-X Ethernet. Применены коммутаторы Spectrum-X SN5600 и сетевые карты на базе чипа BlueField-3. Компания говорит об использовании трёхуровневой Ethernet-сети с 400GbE-подключением, но точная топология не указана. Судя по всему, выделенной сети для работы с хранилищем не предусмотрено. Каждом ускорителю полагается один 400GbE-адаптер SuperNIC, который и объединяет их в RDMA-сеть. Кроме того, у каждого GPU-узла есть ещё один 400GbE DPU, а также подключение к сервисной сети. Сетевые карты находятся в собственных лотках, благодаря чему их можно заменять без демонтажа шасси. По словам NVIDIA, уровень утилизации сети достигает 95 %. В качестве энергетического буфера между электросетью и суперкомпьютером используются аккумуляторные банки Tesla Megapack ёмкостью 3,9 МВт·ч каждый. Они необходимы для того, чтобы компенсировать всплески потребляемой мощности, когда нагрузка на ускорители резко возрастает в силу выполняемых ИИ-задач. Впрочем, вероятно, есть и ещё одна причина для такого решения — на первом этапе Colossus был лишён подключения к основной энергосети и в вопросе питания во многом полагался на генераторы.

28.10.2024 [15:19], Владимир Мироненко

Мало берёте: Дженсен Хуанг пожурил Европу за слабое развитие ИИ и похвалил Индию за закупки десятков тысяч ускорителейКак пишет Data Center Dynamics, генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) сообщил на саммите AI Summit в Мумбаи, что американская компания заключила серию партнёрских соглашений с индийскими фирмами для развёртывания своих чипов и технологий ИИ, расширяя присутсвие на ключевом для себя рынке. С некоторыми из фирм были заключены контракты на поставку десятков тысяч ускорителей H100, в частности, с Tata Communications и Yotta Data Services. Tata Communications модернизирует свою облачную ИИ-инфраструктуру в Индии. Компания начнёт первую фазу крупномасштабного развёртывания NVIDIA Hopper в конце этого года, а на фазе в 2025 году добавит к ним ускорители NVIDIA Blackwell. Как утверждает Tata Communications, её платформа будет одним из крупнейших ИИ-суперкомпьютеров в Индии. Yotta Data Services уже представила шесть новых ИИ-сервисов для своей платформы Shakti Cloud, в том числе на базе NVIDIA NIM. К ним относятся AI Lab, AI Workspace, Serverless AI Inferencing, GPUaaS и др. NVIDIA также сотрудничает с крупнейшим в стране конгломератом Reliance Industries над созданием облачной ИИ-инфраструктуры для обработки данных, обучения сотрудников и создания собственных больших языковых моделей с поддержкой распространённых в стране языков. В рамках партнёрства Reliance развернёт суперускорители GB200. Tech Mahindra намерена использовать чипы и ПО NVIDIA для разработки ИИ-модели на хинди под названием Indus 2.0. Работа над этим проектом будет вестись в Центре передового опыта (Center of Excellence), базирующемся в лабораториях Tech Mahindra в Пуне и Хайдарабаде. На прошлой неделе Дженсен Хуанг также принял участие в церемонии запуска суверенного ИИ-суперкомпьютера Gefion. По данным ресурса The Register, в своём выступлении Хуанг отметил, что ЕС должен ускорить прогресс в области ИИ. «В каждой стране пробуждается понимание того, что данные — это национальный ресурс», — заявил гендиректор NVIDIA. Европейским странам необходимо больше инвестировать в ИИ, если они хотят сократить разрыв с США и Китаем, подчеркнул глава NVIDIA, подразумевая, что лучшим средством для этого будут ускорители его компании.

28.10.2024 [14:18], Руслан Авдеев

Дженсен Хуанг заявил, что Индия должна стать одним из лидеров в области ИИ и создать собственную инфраструктуруНа мероприятии AI Summit в Мумбаи глава NVIDIA Дженсен Хуанг (Jensen Huang) заявил, что ИИ должен стать драйвером цифровой трансформации Индии, её экономического роста и достижения ведущей роли на мировой арене. Как сообщает пресс-служба компании, Индия имеет для прогресса «поразительные естественные ресурсы» в сфере IT и огромный потенциал, который ещё предстоит раскрыть. По словам Хуанга, страна должна стать разработчиком собственного ИИ, создав национальную ИИ-инфраструктуру с опорой на собственные ресурсы и данные. Ведущие облачные провайдеры страны быстро наращивают ёмкость своих ЦОД, а NVIDIA намерена играть ключевую роль в развитии ИИ и предложить свои ускорители — к концу года их использование должно вырасти десятикратно, став основой экономики, основанной на ИИ-системах. Вместе с NVIDIA эти компании должны совершить крупнейший прорыв в вычислениях, сравнимый с появлением IBM System 360 в 1964 году. А с быстрым развитием ИИ-инфраструктуры «умные» производства тоже станут критически важными для будущего Индии. Хуанг обозначил три ключевых сферы развития ИИ: суверенный ИИ (использование собственных данных для инноваций без передачи их за рубеж), «агентский» ИИ для автоматизации наукоёмких работ и «физический» ИИ для роботизированных и промышленных систем. По словам Хуанга, Индия может стать лидером во всех трёх областях. Местные стартапы уже начали использовать технологии NVIDIA для инновационных решений, которые решения на мировой рынок. После монолога Хуанга состоялся диалог с председателем индийской Reliance Industries Мукешем Амбани (Mukesh Ambani). Главы компаний обсудили перспективы трансформации индийской экономики с помощью ИИ-систем, в том числе энергетики, телекоммуникаций и производства. Амбани подчеркнул, что ИИ используется и в государственном секторе для обработки местных данных, что уже меняет принципы управления и обслуживания. Хуанг пообещал, что ИИ дополнительно демократизирует использование технологий — ИИ может использоваться любым гражданином, что открывает перед всеми невероятные возможности. Конечно, Хуанг подчеркнул роль NVIDIA в этой трансформации. Сейчас компания уже сотрудничает с Infosys, TCS, Tech Mahindra, Wipro и т.д., помогая повышать квалификацию около полумиллиона разработчиков. Амбани, в свою очередь, подчеркнул, что страна уже имеет молодые, технически грамотные кадры. Бизнесмены сошлись во мнении, что с огромным числом талантов, развивающейся технической экосистемой и огромными массивами данных страна имеет большой потенциал для вклада в различные секторы экономики на мировом уровне. Конечно, это может быть сделано только при сотрудничестве компаний — ни одному отдельному игроку такие задачи не под силу. Буквально на днях сообщалось, что Индия на государственном уровне обсуждает с NVIDIA совместную разработку ИИ-чипов, адаптированных к местной специфике. Страна активно осваивает связанные с искусственным интеллектом технологии — потратит $1,2 млрд на суверенный ИИ-суперкомпьютер с 10 тыс. ускорителей и собственные LLM, и готова покупать ускорители в больших объёмах, в том числе ослабленные варианты, не доставшиеся Китаю после ужесточения американских санкций.

26.10.2024 [14:00], Сергей Карасёв

Дженсен Хуанг и король Фредерик X запустили самый производительный в Дании ИИ-суперкомьютер GefionОснователь и генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) и король Дании Фредерик X объявили о запуске крупнейшего в стране суверенного суперкомпьютера для задач ИИ. Система получила название Gefion («Гевьон») — в честь скандинавской богини плодородия. НРС-комплекс эксплуатируется Датским центром инноваций в области искусственного интеллекта (DCAI), который был создан при поддержке фонда Novo Nordisk Foundation и Датского фонда экспорта и инвестиций. В церемонии ввода Gefion в эксплуатацию, проходившей в Копенгагене, приняла участие Надя Карлстен (Nadia Carlsten), генеральный директор DCAI. Суперкомпьютер объединяет 191 систему DGX H100, что в общей сложности даёт 1528 ускорителей NVIDIA H100. Задействованы 382 процессора Intel Xeon Platinum и интерконнект NVIDIA Quantum-2 InfiniBand. Прочие технические характеристики, а также показатели быстродействия системы пока не раскрываются. Пиковая теоретическая FP64-производительность должна составить около 52 Пфлопс, а в FP8-расчётах с разреженностью — порядка 6 Эфлопс. Сообщается, что Gefion будет применяться для решения сложных задач в области квантовых вычислений, «зелёной» энергетики, биотехнологий и пр. В частности, исследователи из Копенгагенского университета (UCPH) намерены задействовать машину для проведения крупномасштабного распределённого моделирования квантовых компьютерных схем. Кроме того, UCPH, Технический университет Дании (DTU), Novo Nordisk и Novonesis совместно разработают многомодальную геномную ИИ-модель для анализа мутаций заболеваний и разработки вакцин. Доступ к Gefion также получат стартапы, реализующие перспективные проекты в области обработки текста, изображений и видео. Суперкомпьютер размещён в одном из дата-центров Digital Realty на территории Дании. Этот объект на 100 % получает питание от возобновляемых источников энергии. Сборкой и установкой вычислительного комплекса занимались специалисты Eviden. |

|