Компания NVIDIA в ходе выставки Computex 2023 сообщила о начале серийного производства суперчипов GH200 Grace Hopper, предназначенных для построения НРС-систем и платформ генеративного ИИ. Ожидается, что изделия возьмут на вооружение ведущие облачные провайдеры и гиперскейлеры, включая Google, Meta✴ и Microsoft.

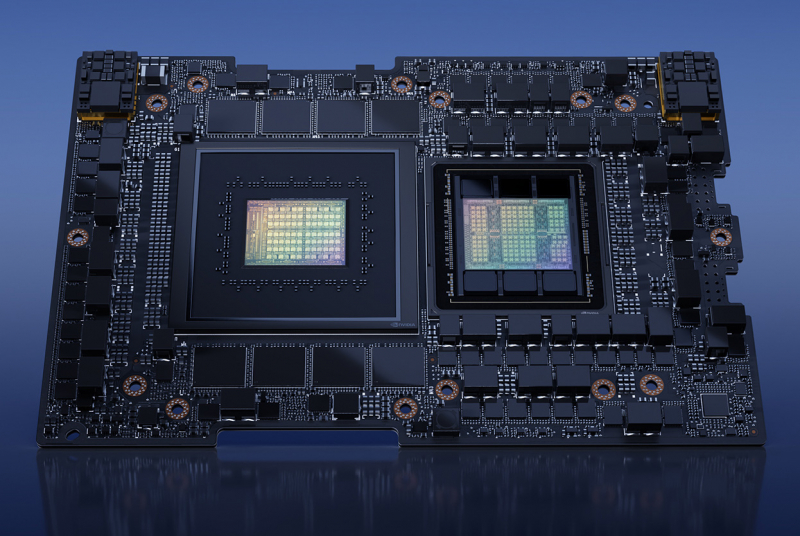

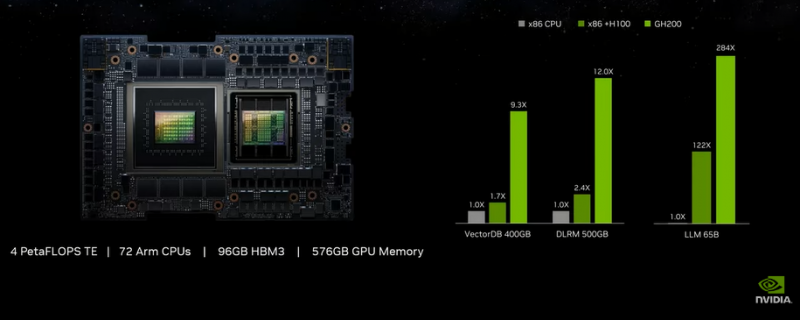

В состав Grace Hopper входят 72-ядерный Arm-процессор NVIDIA Grace и ускоритель NVIDIA H100 с 96 Гбайт HBM3. Объём общей для обоих кристаллов памяти составляет 576 Гбайт (480 Гбайт LPDDR5x). Кристаллы соединены между собой шиной NVLink-C2C, обеспечивающей пропускную способность 900 Гбайт/с: это приблизительно в семь раз больше по сравнению с PCIe 5.0. Заявленный уровень производительности GH200 — 4 Пфлопс с использованием Transformer Engine.

«Генеративный ИИ быстро трансформирует IT-пространство, предоставляя новые возможности и ускоряя открытия в здравоохранении, финансах, бизнес-сфере и многих других отраслях. С началом серийного выпуска суперчипов Grace Hopper производители по всему миру вскоре представят ускоренные инфраструктуры для решения ИИ-задач корпоративного класса на основе уникальных массивов данных», — сказал Иэн Бак (Ian Buck), вице-президент HPC-подразделения NVIDIA.

Говорится, что в число производителей серверов с ускорителями NVIDIA входят такие компании, как Cisco, Dell Technologies, Gigabyte, HPE, Lenovo, Supermicro, Eviden (Atos). Среди тайваньских партнёров компании были названы AAEON, Advantech, Aetina, ASRock Rack, ASUS, GIGABYTE, Ingrasys, Inventec, Pegatron, QCT, Tyan, Wistron и Wiwynn. Изделия NVIDIA H100 уже применяют в составе своих платформ облачные провайдеры AWS, Cirrascale, CoreWeave, Google Cloud, Lambda, Microsoft Azure, Oracle Cloud, Paperspace и Vultr.

Системы нового поколения на базе NVIDIA Grace, Hopper и Ada Lovelace обеспечат поддержку полного набора ПО NVIDIA, включая NVIDIA AI Enterprise, NVIDIA Omniverse и NVIDIA RTX. Платформы на основе суперчипов GH200 Grace Hopper станут доступны позднее в текущем году.

Источник: