Материалы по тегу: кластер

|

09.11.2023 [14:56], Сергей Карасёв

Китай развернул первый облачный кластер на базе RISC-VШаньдунский университет в Китае, по сообщению HPC Wire, развернул в облаке первый коммерческий кластер с серверами, оснащёнными процессорами на открытой архитектуре RISC-V. Это очередная попытка КНР сократить зависимость от зарубежных технологий в свете возрастающего санкционного давления со стороны США. В составе запущенной платформы задействованы процессоры Sophgo SOPHON SG2042 с 64 ядрами RISC-V и 64 Мбайт кеша L3. Тактовая частота достигает 2,0 ГГц. Реализована поддержка интерфейса PCIe Gen 4. В составе системы в общей сложности объединены 48 узлов, что в сумме даёт 3072 ядра. Система, как отмечается, предназначена прежде всего для учебных и исследовательских целей. Однако она также поддерживает работу определённых облачных инстансов.

Источник: RISC-V Summit У Китая есть комплексный план по разработке собственных чипов RISC-V. В этом году Министерство науки и технологий КНР профинансировало разработку таких чипов, и многие университеты и научные лаборатории также подключились к созданию таких изделий. В мае Китайская академия наук представила 2-ГГц процессор Xiangshan на архитектуре RISC-V, тогда как ведущие китайские RISC-V-разработчики сформировали патентный альянс. Говорится, что ведётся разработка изделия Xiangshan-v3: в проекте принимают участие крупные китайские компании, включая Alibaba, Tencent и ZTE. По производительности новый чип будет сопоставим с Arm Neoverse-N2. Ранее говорилось, что американские санкции против Китая могут ускорить распространение архитектуры RISC-V. Вместе с тем высказываются опасения, что запуск Пекином облачного RISC-V-кластера может привлечь дополнительное внимание со стороны регуляторов США. Законодатели в Палате представителей призвали запретить американским компаниям работать с китайскими организациями над технологиями RISC-V.

21.10.2023 [15:51], Сергей Карасёв

Мини-кластер Mixtile Cluster Box с четырьмя одноплатными компьютерами рассчитан на edge-приложенияДля заказа, по сообщению ресурса CNX Software, доступен кластер небольшого форм-фактора Mixtile Cluster Box, предназначенный для решения задач в сфере периферийных вычислений или малого бизнеса. По сути, новинка представляет собой корпус со встроенным коммутатором PCIe, предназначенный для размещения четырёх одноплатных компьютеров Mixtile Blade 3. Каждая из плат Mixtile Blade 3 несёт на борту процессор Rockchip RK3588, который объединяет квартеты ядер Cortex-A76 и Cortex-A55, ускоритель Arm Mali G610MC4 и NPU-блок производительностью до 6 TOPS. Объём оперативной памяти LPDDR4 достигает 32 Гбайт, вместимость флеш-чипа eMMC — 256 Гбайт.

Источник изображения: Mixtile Управляющая плата использует MIPS-процессор MediaTek MT7620A с частотой 580 МГц. Есть 256 Мбайт памяти DDR2 и 16 Мбайт памяти SPI Flash. Задействован PCIe-коммутатор ASMedia ASM2824 с четырьмя разъёмами PCIe 3.0 х4. Система работает под управлением OpenWrt 22.03 Для накопителей доступны четыре слота M.2 M-Key (NVMe; PCIe 3.0 x2) и четыре порта SATA-3 (все подключены к Mixtile Blade 3). Для каждого из узлов на базе Mixtile Blade 3 предусмотрены по два сетевых порта RJ-45, по два интерфейса HDMI и по два порта USB 3.2 Gen1 Type-C. Собственно кластер оснащён двумя портами SFF-8643 и гнездом RJ-45. В системе охлаждения применены два вентилятора диаметром 60 мм. Габариты составляют 213 × 190 × 129 мм. Питание подаётся через DC-разъём. Диапазон рабочих температур простирается от 0 до +80 °C. Приобрести Mixtile Cluster Box можно за $339 (без одноплатных компьютеров в комплекте).

07.09.2023 [21:25], Алексей Степин

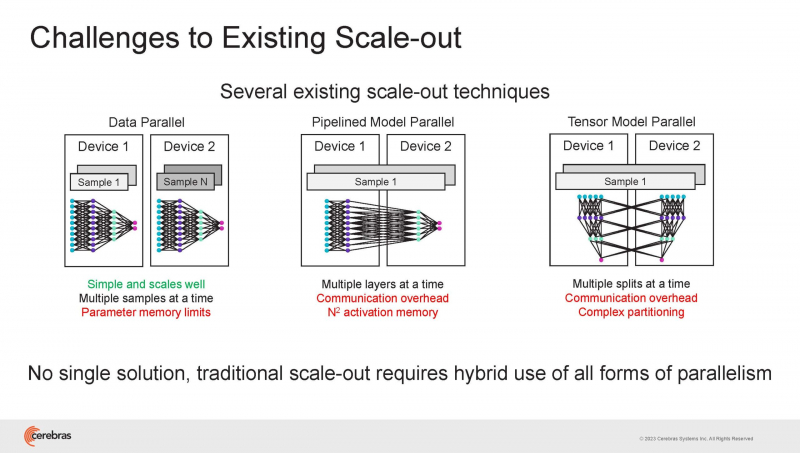

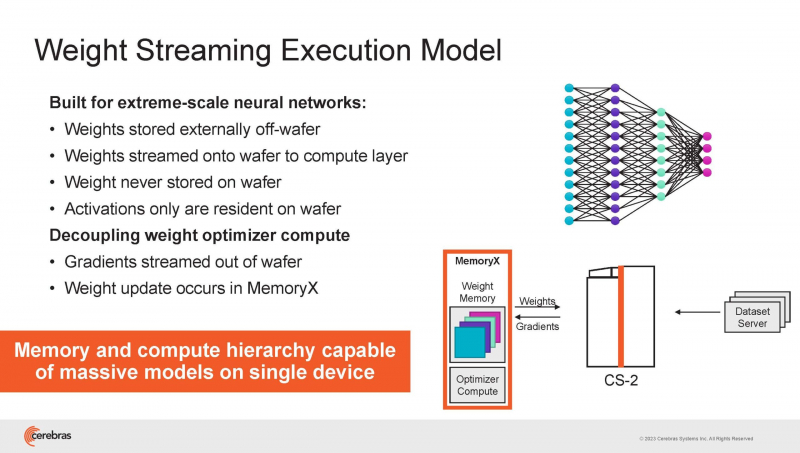

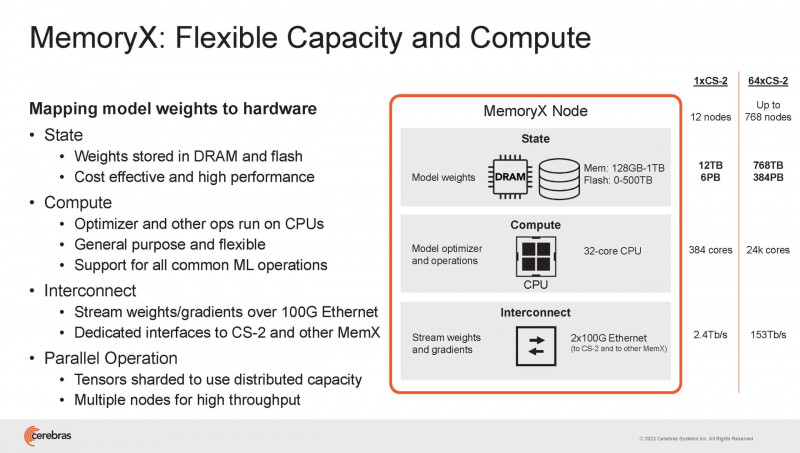

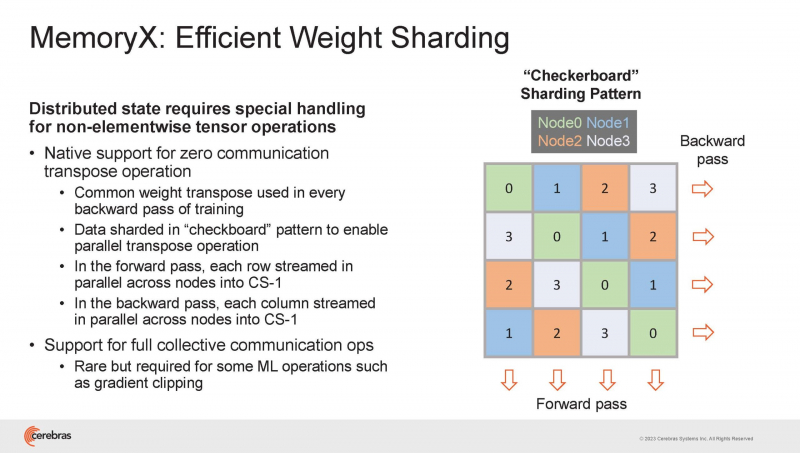

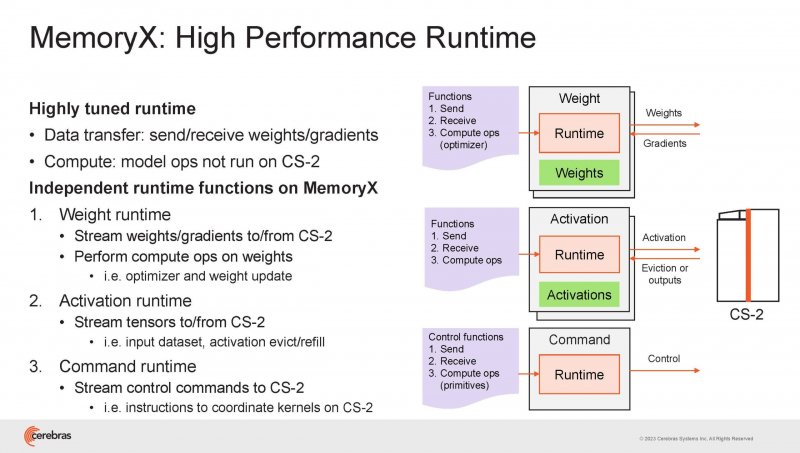

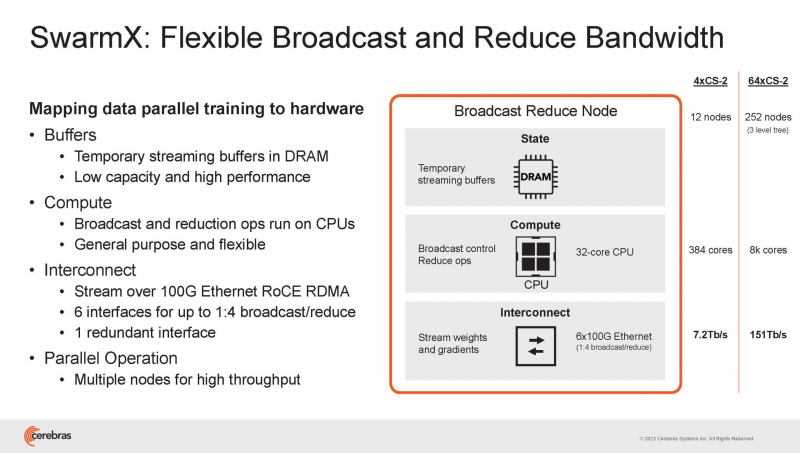

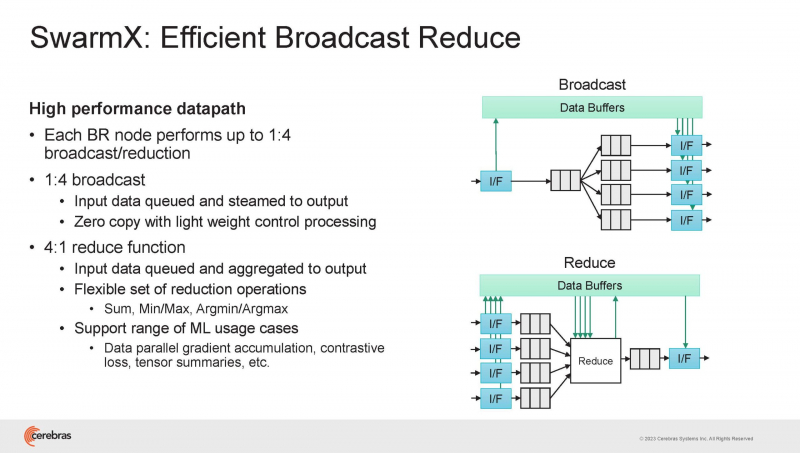

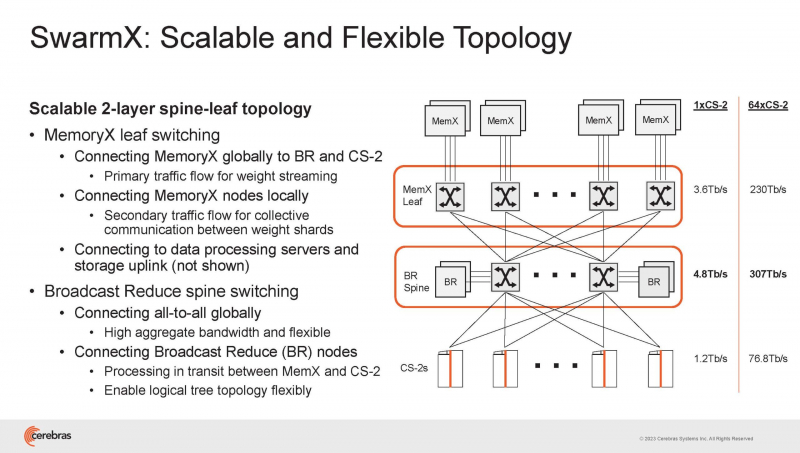

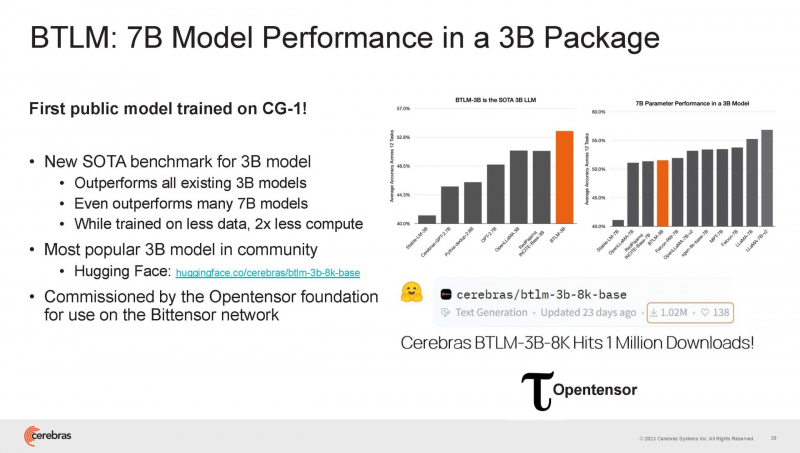

Cerebras готова к построению масштабных ИИ-кластеров CS-2 с 163 млн ядерНа прошедшей недавно конференции Hot Chips 2023 компания Cerebras, создатель самого большого в мире ИИ-процессора WSE-2, рассказала о своём видении будущего ИИ-систем. По мнению Cerebras, сфокусировать внимание стоит не столько на наращивании сложности отдельных чипов, сколько на решениях проблем, связанных с масштабированием кластеров. Свою презентацию Cerebras начала с любопытных фактов: за прошедшие пять лет сложность ИИ-моделей возросла в 40 тыс. раз. И этот темп явно опережает темпы развития чипов-ускорителей. Хотя налицо прогресс и в техпроцессах (5x), и в архитектуре (14x), и во внедрении более эффективных для ИИ форматов данных, но наибольший прирост производительности обеспечивает именно возможность эффективного масштабирования. Однако и этого недостаточно — 600-кратный прирост от кластеризации явно теряется на фоне 40-тыс. усложнения самих нейросетей. А дальнейший рост масштабов ИИ-комплексов в их классическом виде, состоящих из множества «малых» ускорителей, неизбежно приводит к проблемам с организацией памяти, интерконнекта и вычислительных мощностей. В итоге решение любой задачи в таких системах часто упирается в необходимость тончайшей, но при этом далеко не всегда эффективной оптимизации разделения ресурсов. При этом разные методы масштабирования имеют свои проблемы — узким местом могут оказаться и память, и интерконнект, и конкретный подход к организации кластера. Cerebras же предлагает совершенно иной подход. Выход компания видит в создании огромных чипов-кластеров, таких, как 7-нм Cerebras WSE-2. Этот чип на сегодня можно назвать самым большим в индустрии: его площадь составляет более 45 тыс. мм2, при этом он содержит 2,6 трлн транзисторов и имеет 850 тыс. ядер, дополненных 40 Гбайт сверхбыстрой памяти. Что интереснее, кластер на базе CS-2 представляется с точки зрения исполняемой модели, как единая система. Сама по себе сложность WSE-2 и платформы CS-2 на его основе такова, что позволяет запускать модели практически любых размеров, благо весовые коэффициенты чип в себе не хранит, а подгружает извне с помощью подсистемы MemoryX. При этом сама по себе платформа CS-2 допускает и дальнейшее масштабирование: с помощью интерконнекта SwarmX в единый кластер можно объединить до 192 таких машин, что в теории позволит поднять производительность до 8+ Эфлопс. Подсистема MemoryX включает в себя 12 узлов, за оптимизацию модели в ней отвечают 32-ядерные процессоры, а веса хранятся как в DRAM, так и во флеш-памяти — объёмы этих подсистем составляют 12 Тбайт и 6 Пбайт соответственно. Каждый узел имеет по 2 порта 100GbE — один для закачки данных в CS-2, второй для общения с другими MemoryX в кластере. Оптимизация данных производится на процессорах MemoryX, «мегачипы» CS-2 для этого не используются. Подсистема интерконнекта SwarmX базируется на 100GbE с поддержкой RoCE DRMA, но имеет ряд особенностей: на каждые четыре системы CS-2 приходтся 12 узлов SwarmX c производительностью интерконнекта 7,2 Тбит/с. Трансляция и редуцирование данных осуществляются с коэффициентом 1:4, причём и здесь используются силы собственных 32-ядерных процессоров, а не ресурсы CS-2. Топологически SwarmX имеет двухслойную конфигурацию spine-leaf и обеспечивает соединение типа all-to-all, при этом каждая CS-2 имеет свой канал с пропускной способностью 1,2 Тбит/с. Сочетание MemoryX и SwarmX позволяет делать кластеры на базе CS-2 крайне гибкими: размер модели ограничивается лишь ёмкостью узлов MemoryX, а степень параллелизма — их количеством. При этом интерконнект обладает достаточной степенью избыточности, чтобы говорить об отсутствии единых точек отказа. Таким образом, Cerebras имеет на руках всё необходимое для запуска самых сложных моделей искусственного интеллекта. Уже сравнительно немолодой кластер Andromeda, включающий всего 16 платформ CS-2, способен «натаскивать» за считанные недели нейросети размерностью до 13 млрд параметров. При этом масштабирование по размеру модели не требует серьёзного вмешательства в программный код, в отличие от классического подхода для ускорителей NVIDIA. Фактически для сетей и с 1, и со 100 млрд параметров используется один и тот же код. Более мощный 64-узловой комплекс Condor Galaxy 1 (CG-1), располагающий 54 млн ИИ-ядер и развивающий до 4 Эфлопс уже доказал, что подход к масштабированию, продвигаемый Cerebras, оправдывает себя. Он успешно обучил первую публичную модель с 3 млрд параметров, причём по возможностям она приближается к моделям с 7 млрд параметров. И это не предел: напомним, в текущем воплощении сочетание подсистем MemoryX и интерконнекта SwarmX допускает объединение в единый кластер до 192 узлов CS-2. Компания считает, что она полностью готова к наплыву ещё более сложных нейросетей, а предлагаемая ей архитектура в явном виде лишена многих узких мест, свойственных традиционным GPU-архитектурам. Насколько успешным окажется такой подход в более отдалённой перспективе, покажет время.

31.08.2023 [13:59], Сергей Карасёв

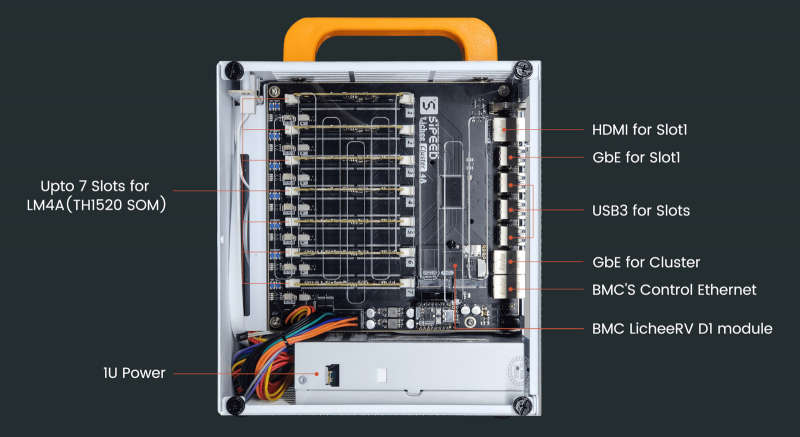

Sipeed представила кластер Lichee Cluster 4A на архитектуре RISC-VКомпания Sipeed, по сообщению CNX-Software, подготовила к выпуску компактный кластер Lichee Cluster 4A на архитектуре RISC-V. Продажи новинки, функционирующей под управлением Debian, начнутся в сентябре нынешнего года. Изделие допускает установку семи вычислительных модулей Lichee Module 4 Model A (LM4A). Они наделены чипом Xuantie C910 (RV64GCV) с четырьмя ядрами RISC-V, нейропроцессорным блоком (NPU) производительностью до 4 TOPS, энергоэффективным ядром Xuantie E902, графическим узлом Imagination 3D (50 Гфлопс) и DSP Xuantie C906. Кластер может нести на борту в сумме до 112 Гбайт оперативной памяти LPDDR4X и до 896 Гбайт флеш-памяти eMMC. Доступны семь слотов для карт microSD — по одному на модуль LM4A. В оснащение Lichee Cluster 4A входят сетевые порты 1GbE для кластера в целом и одного из разъёмов для вычислительных модулей, интерфейс HDMI, семь портов USB 3.0 и один порт USB 2.0, а также Ethernet-порт (BMC) для управления. Габариты новинки составляют 200 × 120 × 220 мм. Питание может подаваться от внутреннего блока или через DC-разъём. В верхней части устройства предусмотрена ручка для переноски. За охлаждение отвечает активная система с вентилятором, имеющим боковое расположение.

28.07.2023 [12:50], Сергей Карасёв

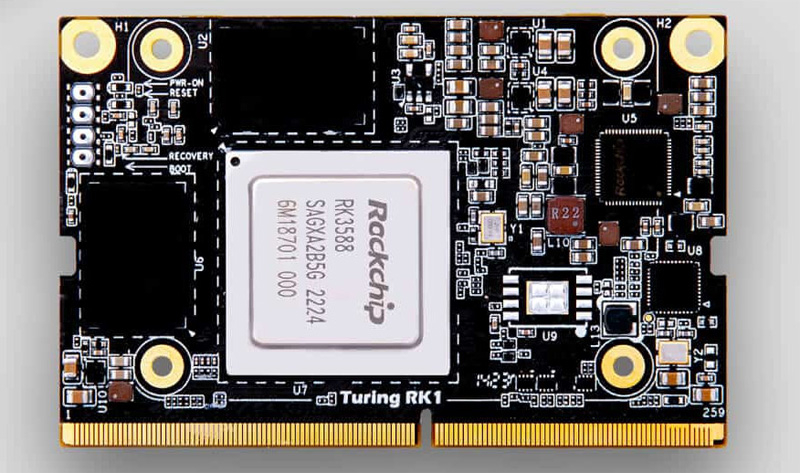

Представлен модуль Turing RK1 с процессором Rockchip RK3588 для создания ИИ-кластеровКоманда Turing Pi, предлагающая решения для построения вычислительных кластеров, начала приём заказов на модуль Turing RK1 для решения задач в области ИИ, Интернета вещей, робототехники, периферийных приложений и пр. Изделие использует платформу Ubuntu Server 22.04 LTS. В основу положен процессор Rockchip RK3588, объединяющий четыре ядра Cortex-A76 с частотой до 2,4 ГГц, четыре ядра Cortex-A55 с частотой до 1,8 ГГц и ускоритель Arm Mali-G610 MP4. В состав чипа входит нейропроцессорный блок (NPU) с производительностью до 6 TOPS. Есть возможно декодирование видео 8K@60p H.265/VP9/AVS2.

Источник изображений: Turing Pi Объём оперативной памяти составляет 8, 16 или 32 Гбайт. За хранение данных отвечает модуль eMMC 5.1 вместимостью 32 Гбайт. Реализована поддержка интерфейсов SD 3.0, HDMI 2.1 (до 8Kp60), DisplayPort 1.4, MIPI DSI, MIPI CSI Rx (×2; четыре линии), MIPI CSI DPHY Rx (четыре линии), I2S (×2), 1GbE, USB 3.0 (×2), USB 2.0 (×2) и PCIe 3.0.  Новинка выполнена в виде 260-контактного модуля SO-DIMM. Габариты составляют 69,6 × 45 мм, вес — 17 г. Питание подаётся через интерфейс USB Type-С (5 В). Диапазон рабочих температур простирается от -20 до +70 °C. На основе Turing RK1 могут формироваться ИИ-кластеры. Цена варьируется от $130 до $260 в зависимости от размера ОЗУ. Ещё за $10 можно приобрести блок охлаждения с радиатором и небольшим вентилятором. |

|